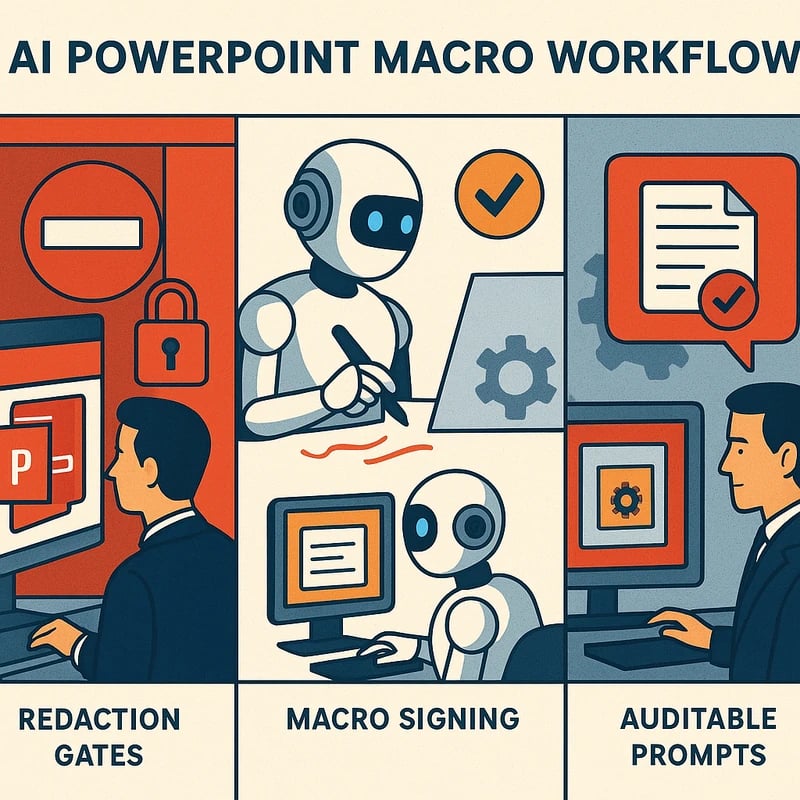

ค้นพบวิธีที่เวิร์กโฟลว์แมโคร AI PowerPoint สมดุลระหว่างความเร็วกับความปลอดภัย ด้วยการลบข้อมูล, การลงนาม, และข้อความกระตุ้นที่ตรวจสอบได้ เพื่อมอบชุดสไลด์ให้ลูกค้าปฏิบัติตามข้อกำหนด

คำตอบโดยย่อ

ความเร็วของแมโคร PowerPoint ที่ขับเคลื่อนได้วย AI สามารถเปลี่ยนการผลิตสไลด์สำหรับลูกค้าได้ แต่ความปลอดภัยและระเบียบด้านนโยบายเป็นสิ่งที่ไม่สามารถต่อรองได้ กระบวนการทำงานที่ชัดเจนสุดประกอบด้วยการลบข้อมูลก่อนการสร้าง โมเดลที่ใช้งานแบบออฟไลน์หรือตามที่องค์กรอนุมัติ การลงนามแมโคร การดำเนินการด้วยสิทธิ์ขั้นต่ำ และ prompt ที่สามารถตรวจสอบได้ เมื่อมีประตูนโยบายอยู่ ให้ใช้เวิร์กโฟลว์ที่เปิด Copilot พร้อมการกำกับดูแล หรือหันไปใช้วิธี on‑prem/แบบแมนนวลเพื่อปกป้อง NDA และข้อมูลที่เป็นความลับ

ข้อคิดสำคัญ: ความเร็วโดยไม่มีมาตรการคุ้มครองไม่สามารถขยายได้—คุณต้องการกระบวนการที่ตรวจสอบได้และขับเคลื่อนด้วยนโยบายสำหรับการใช้งาน AI PowerPoint แมโคร

คู่มือฉบับสมบูรณ์สำหรับ AI PowerPoint แมโคร

บริบทมีความสำคัญเมื่อคุณกำลังสร้างเด็คที่นำเสนอลูกค้า ความสมดุลระหว่างความเร็วกับความปลอดภัยไม่ใช่การเลือกที่คุณยอมรับได้โดยพิจารณาจากปัจจัยทั่วไป แต่มันคือปัญหาการกำกับดูแลที่มีขั้นตอนที่เป็นจริงและทำซ้ำได้ คู่มือนี้กำหนดเวิร์กโฟลว์ที่พร้อมใช้งานสำหรับองค์กรในการใช้งาน AI PowerPoint แมโครที่เคาร parcel พรมแดนข้อมูล สัญญากับลูกค้า และการควบคุมภายใน

-

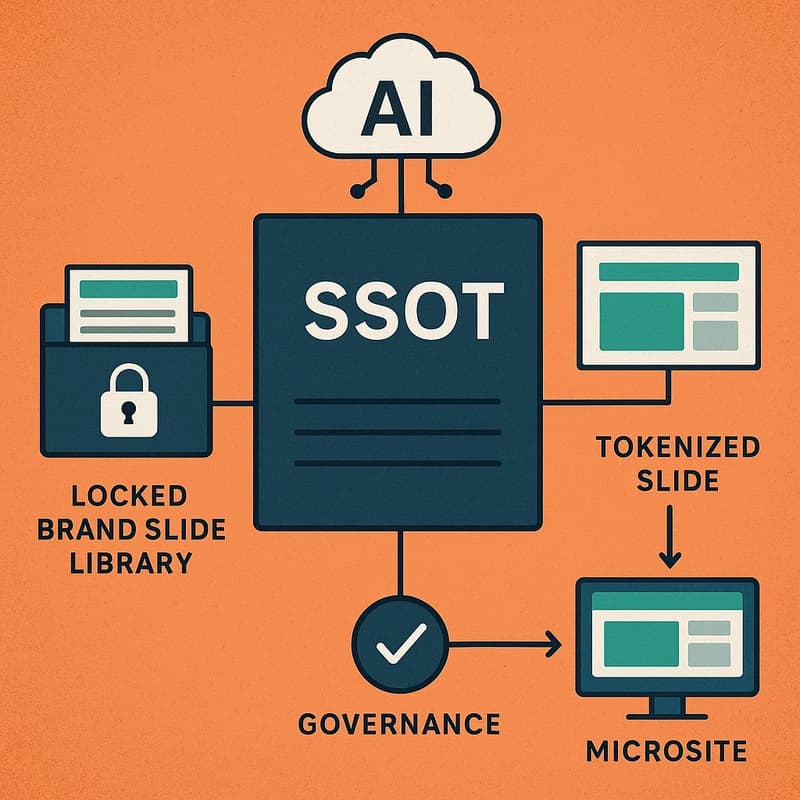

การจัดประเภทข้อมูลมาก่อน กำหนดว่าสามารถใช้ในการสร้างด้วย AI ได้อะไร และอะไรที่ต้องถูกลบหรือเปลี่ยนเป็น placeholder การดำเนินการประเมินความอ่อนไหวของข้อมูลก่อนแตะต้องเนื้อหาของลูกค้าด้วยเครื่องมือ AI ใช้ประตูป้ายกำกับข้อมูล (Public, Internal, Confidential, Restricted) ที่สอดคล้องกับระบบ DLP และการป้องกันการรั่วไหลของข้อมูล กระบวนการแมโคร AI PowerPoint ที่เข้มแข็งควรถือว่าคอนเทนต์เป็นข้อมูลที่ต้องได้รับการป้องกันโดยค่าเริ่มต้น

-

โมเดลในเครื่องหรือตามองค์กร แนะนำให้ใช้ความสามารถ AI แบบออฟไลน์หรือบน premises สำหรับสิ่งที่แตะต้องข้อมูลที่เป็นความลับ หากจำเป็นต้องใช้โมเดลคลาวด์ ให้ส่งผ่านเฉพาะ prompt ที่ไม่เป็นความลับ หรือใช้โมเดลระดับองค์กรที่ผ่านการตรวจสอบพร้อมข้อตกลงการจัดการข้อมูลอย่างเคร่งครัดและการแยกเซสชัน โมเดลขององค์กรควรให้ความเคารพต่อข้อจำกัดการเก็บรักษาและไม่มีการส่งออกข้อมูลนอกการควบคุมของคุณ ซึ่งช่วยให้ผลลัพธ์ของ AI PowerPoint แมโคร stay within your corporate boundary

-

การลงนามแมโครและความน่าเชื่อถือ ตรวจสอบให้แน่ใจว่าแมโครที่สร้างด้วย AI หรือแม่แบบที่ช่วยแมโครทั้งหมดถูกลงนามด้วยลายเซ็นดิจิทัลโดยผู้เผยแพร่ที่เชื่อถือได้ กำหนดนโยบายที่ห้ามแมโครที่ไม่ได้รับความเชื่อถือรันโดยปราศจากเวิร์กโฟลว์การอนุมัติอย่างเป็นทางการ ใช้ใบรับรองการลงนามโค้ดและที่เก็บแมโครส่วนกลางที่มีการควบคุมเวอร์ชันและขั้นตอนการเพิกถอน

-

การดำเนินการด้วยสิทธิ์น้อยที่สุด รันแมโคร PowerPoint ด้วยสิทธิ์ขั้นต่ำที่จำเป็นและไม่มีสิทธิผู้ดูแลระบบบนอุปกรณ์ของผู้ใช้งาน จำกัดการเข้าถึงเครือข่ายสำหรับเซสชันที่เปิดใช้งานแมโคร และปิดใช้งานหรือแซนด์บ็อกใด ๆ ที่อาจรั่วข้อมูล ใช้การ whitelist แอปพลิเคชันเพื่อให้เฉพาะแมโครที่ได้รับอนุมัติเท่านั้นที่ทำงานในสภาพแวดล้อมที่ควบคุม

-

prompts ที่เป็นมิตรต่อนโยบาย ออกแบบ prompts ที่หลีกเลี่ยงการขอข้อมูลลับหรือคาดเดาข้อมูลลับ ใช้ placeholders (เช่น [CLIENT_NAME], [CONTRACT_VALUE]) ที่ถูกแทนที่เฉพาะในสภาพแวดล้อมที่ปลอดภัยและถูกปกปิดข้อมูล รักษาคลัง prompts ที่สอดคล้องกับนโยบายการกำกับดูแลข้อมูล ข้อกำหนด NDA และข้อจำกัดเฉพาะลูกค้า

-

ประตูลบข้อมูลและการบูรณาการการจัดประเภท ก่อนที่เด็คจะออกจากสภาพแวดล้อมของคุณ ให้รันการลบข้อมูลอัตโนมัติเพื่อลบหรือปิดบังข้อมูลระบุตัวตนที่มีความอ่อนไหว เชื่อมกระบวนการลบข้อมูลกับสถาปนาการจัดประเภทข้อมูลของคุณ เพื่อให้ผลลัพธ์ของแต่ละ prompt อยู่ในขอบเขตที่สอดคล้องกับนโยบาย

-

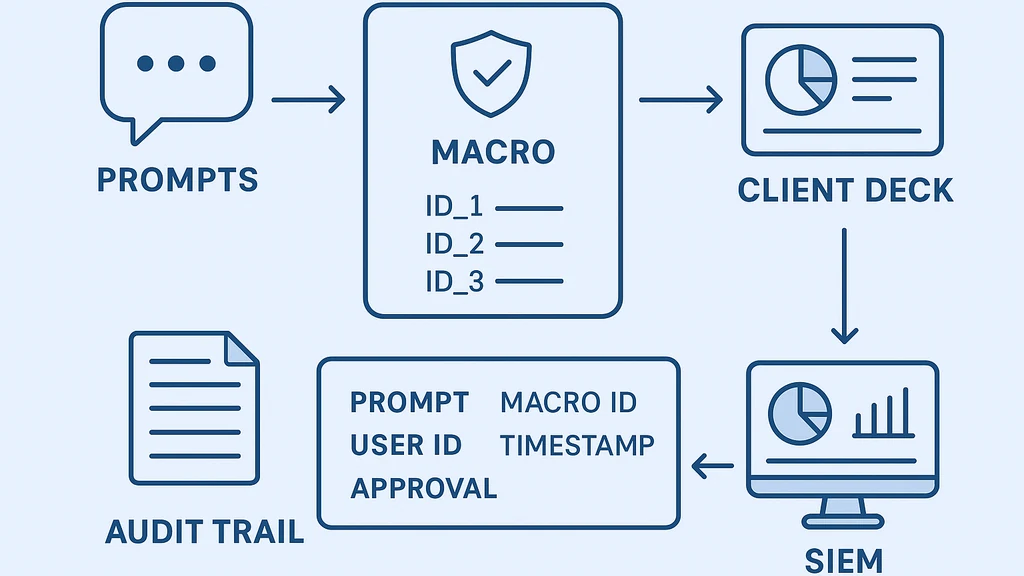

prompt และผลลัพธ์ที่ตรวจสอบได้ บันทึก prompts อินพุต ผลลัพธ์ รหัสแมโคร รหัสผู้ใช้ เวลาประทับ และการอนุมัติไว้ในร่องรอยการตรวจสอบที่ไม่สามารถเปลี่ยนแปลงได้ เชื่อมร่องรอยนี้กับระบบวิเคราะห์ข้อมูลระดับองค์กรหรือระบบ SIEM ทำให้ผู้ตรวจสอบสามารถติดตามได้ง่ายว่าเด็คถูกผลิตขึ้นอย่างไร ใช้ข้อมูลใด และใครเป็นผู้อนุมัติ

-

การควบคุมเวอร์ชันและการอนุมัติ ใช้ระบบเวอร์ชันเด็คอย่างเป็นทางการ โดยต้องการการอนุมัติสำหรับเด็คที่ใช้ AI ที่นำไปสู่การนำเสนอแก่ลูกค้า ติดตามการเปลี่ยนแปลง เก็บเหตุผลของการเลือก AI และต้องการการลงนามจากเจ้าหน้าที่การกำกับดูแลข้อมูลหรือฝ่ายความปลอดภัยก่อนการส่งมอบให้ลูกค้า

-

ต้นไม้การตัดสินใจระหว่าง Copilot กับ on-prem เมื่อ Copilot ได้รับอนุญาตเมื่อใด เมื่อไรที่ไม่อนุญาต หากข้อมูลถูกควบคุมหรือมีความละเอียดอ่อน ให้ค่าเริ่มต้นเป็น on-prem หรือเวิร์กโฟลว์แบบออฟไลน์ หากการมีส่วนร่วมกับลูกค้ายอมให้ใช้งาน Copilot โดยมีข้อจำกัดด้านนโยบาย ให้เปิดใช้งานภายใต้ประตูที่เข้มงวด (การลบข้อมูล, prompts ที่ผ่านการตรวจสอบโดยนโยบาย, และการทบทวนหลังการสร้าง) แผนผังขั้นตอนที่ชัดเจนจะช่วยให้ทีมตัดสินใจได้แบบเรียลไทม์

-

ตัวอย่างเชิงปฏิบัติ วิศวกรฝ่ายขายใช้แมโคร AI PowerPoint ที่เป็นแม่แบบเพื่อเติมเด็คทั่วไปด้วยเมทริกของลูกค้าที่ถูกลบข้อมูล จากนั้นผู้ตรวจสอบการปฏิบัติตามข้อบังคับอนุมัติเวอร์ชันด้วยการลงนามเพียงคลิกเดียว เด็คสุดท้ายถูกบันทึกไว้ในโฟลเดอร์ที่จำกัดพร้อมประวัติเวอร์ชันและการส่งออกมีการบันทึกตรวจสอบ

-

การฝึกอบรมและวัฒนธรรม ดำเนินการฝึกอบรมเป็นประจำเกี่ยวกับการจัดประเภทข้อมูล เทคนิคการลบข้อมูล การลงนามแมโคร และการเตรียมพร้อมสำหรับการตรวจสอบ ใช้เด็คลูกค้าที่จำลองเพื่อฝึกเวิร์กโฟลว์การกำกับดูแล เพื่อให้ทีมมีความชำนาญกับประตูนโยบายก่อนเริ่มงานจริงกับลูกค้า

-

หัวข้อการกำกับดูแลที่เกี่ยวข้อง เวิร์กโฟลว์นี้เกี่ยวพันกับการป้องกันการรั่วไหลของข้อมูล การจัดประเภทข้อมูล ความสอดคล้อง NDA ความปลอดภัยของแมโคร และการกำกับดูแลห่วงโซ่อุปทานซอฟต์แวร์ การทำให้โดเมนเหล่านี้สอดคล้องกันช่วยลดความเสี่ยงเมื่อคุณขยายการใช้งาน AI PowerPoint แมโครไปยังทีมต่างๆ

ข้อคิดสำคัญ: เวิร์กโฟลว์ AI PowerPoint แมโครที่มีวินัยขึ้นอยู่กับการกำกับดูแลข้อมูล ความเลือกโมเดล การลงนาม การใช้งานด้วยสิทธิ์น้อยที่สุด การลบข้อมูล และบันทึกที่ตรวจสอบได้ องค์ประกอบเหล่านี้ช่วยให้คุณเร่งความเร็วโดยไม่ละเมิด NDA หรือสัญญากับลูกค้า

ทำไมเรื่องนี้ถึงสำคัญ

แรงกดดันในการเร่งรัดเด็คของลูกค้ามีความชัดเจน ในไตรมาสล่าสุด ทีมองค์กรเผชิญกับความตึงเครียระหว่างความเร็วกับความปลอดภัยเมื่อเครื่องมือที่เปิดใช้งานด้วย AI เข้าสู่เวิร์กโฟลว์ ข้อมูลจากการอภิปรายในอุตสาหกรรมชี้ให้เห็นสองรูปแบบที่ชัดเจน:

-

ความขัดแย้งด้านนโยบายกำลังเพิ่มสูงขึ้น การอภิปรายบน Reddit ระหว่างที่ปรึกษาย้ำถึงการพิจารณาใช้ GenAI สำหรับเนื้อหาของลูกค้าและการห้ามหรือข้อจำกัดที่เกิดขึ้นเมื่อทำงานกับเด็คที่เป็นความลับ ผู้ปฏิบัติงานรายงานว่าต้องการต้นไม้การตัดสินใจที่ชัดเจนในการแยกว่า Copilot หรือเครื่องมือสไลด์จากบุคคลที่สามอนุญาตเท่ากันเมื่อเทียบกับวิธี on‑prem หรือแบบแมนนวล

-

ความต้องการการกำกับดูแลที่ตรวจสอบได้เพิ่มขึ้น LinkedIn และเครือข่ายมืออาชีพอื่นๆ เน้นกระแส prompts ที่กระตุ้นให้ “ให้ AI ทำสไลด์ของคุณ” ซึ่งก่อให้เกิดความกังวลเรื่องการรั่วไหลของข้อมูลและความลับของลูกค้า องค์กรต่างๆ เริ่มเรียกร้องบันทึก prompts ที่ตรวจสอบได้และแหล่งที่มาของแมโครเพื่อให้สอดคล้องกับ NDA และข้อกำหนดด้านกฎระเบียบ

สองถึงสามสถิติหรือแนวโน้มของอุตสาหกรรมที่คุณสามารถอ้างอิงในการวางแผนของคุณ:

- องค์กรต่างๆ เริ่มนำ governance AI มาใช้ในการทำงานกับลูกค้า โดยอัตราการนำ governance มาใช้เพิ่มขึ้นในช่วงตัวเลขสองหลักต่ำถึงสูง (ประมาณ 10–19% ต่อปี) ซึ่งการเปลี่ยนแปลงนี้ถูกขับเคลื่อนโดยข้อกำหนดด้านการคุ้มครองข้อมูลและข้อจำกัดตามสัญญากับลูกค้า

- ทีมความปลอดภัยรายงานความกังวลเกี่ยวกับการรั่วไหลของข้อมูลเมื่อ AI ถูกใช้เพื่อสร้างเนื้อหาของลูกค้า กระตุ้นการควบคุมแมโครที่เข้มงวดขึ้น การลบข้อมูล และนโยบายการเข้าถึงตามเซสชัน

- ในสภาพแวดล้อมที่อนุญาตให้ใช้ AI ทีมงานมักพึ่งพาโมเดลออฟไลน์/ท้องถิ่นหรือ Copilots ระดับองค์กรที่มีกฎการจัดการข้อมูลที่เข้มงวด เพื่อหลีกเลี่ยงการรั่วไหลผ่านคลาวด์ โดยมักผสมผสานกับร่องรอยการตรวจสอบที่มั่นคงและเวิร์กโฟลว์การลงนาม

มุมมองจากผู้เชี่ยวชาญที่ควรทราบ: ผู้บริหารย้ำว่า ความเร็วจะต้องควบคู่กับการควบคุมตามนโยบาย ผู้บริหารความปลอดภัยชี้ให้เห็นถึงความจำเป็นของการลบข้อมูลที่อ้างอิงจากการจัดหมวดหมู่และการลงนามแมโครเป็นการควบคุมพื้นฐานสำหรับเวิร์กโฟลว์ AI ที่นำเสนอให้ลูกค้า

ข้อคิดสำคัญ: ช่วงเวลานี้ต้องการวิธีการแบบผสมผสาน — ใช้ AI เพื่อความเร็ว แต่ยึดมั่นเด็คแต่ละชุดด้วยการกำกับดูแล การลบข้อมูล และกระบวนการที่ตรวจสอบได้เพื่อให้สอดคล้องกับความคาดหวังของลูกค้าและข้อกำหนดด้านกฎระเบียบ

ประยุกต์ใช้งานเชิงปฏิบัติ

-

เด็คล่วงหน้าพร้อมเทมเพลตสำหรับการลบข้อมูล ออกแบบเทมเพลตสไลด์ที่ช่วยด้วย AI ซึ่งกรอกข้อมูลลงใน placeholders ที่ไม่เป็นความลับโดยอัตโนมัติ แมโครจะเติม placeholders ในเวอร์ชันที่ถูกปกปิดก่อน แล้วจึงทบทวนและปล่อยเวอร์ชันหลังการอนุมัติ apenas

-

อัตโนมัติที่ให้ความสอดคล้องกับข้อบังคับ ใช้ลายเซ็นดิจิทัลบนแมโครทุกตัวและดูแลที่เก็บแมโครที่ได้รับการอนุมัติอย่างศูนย์กลาง ดำเนินการตรวจสอบอัตโนมัติที่ยืนยันลายเซ็นแมโครและจำกัดการดำเนินการให้อยู่ในแหล่งที่ลงนามและเชื่อถือได้เท่านั้น

-

AI on-prem/offline สำหรับข้อมูลที่อ่อนไหวง เมื่อข้อมูลของลูกค้ามีความอ่อนไหว ให้รันกระบวนการ AI แบบออฟไลน์ทั้งหมด เก็บ prompts และผลลัพธ์ในสภาพแวดล้อมที่แยกออกและส่งออกเฉพาะหลังการลบข้อมูลและการอนุมัติ

-

prompts ที่พร้อมสำหรับการตรวจสอบ รักษาคลัง prompts ที่มีเวอร์ชันเชื่อมโยงกับเด็คที่สร้างขึ้น ตรวจสอบให้ prompts สามารถเข้าถึงได้ผ่านอินเทอร์เฟซที่ควบคุมเท่านั้นและบันทึกการใช้งาน prompts ทุกครั้ง

-

เวิร์กโฟลว์ที่ขับเคลื่อนด้วยต้นไม้การตัดสินใจ ใส่ต้นไม้การตัดสินใจที่เรียบง่ายไว้ในเอกสารการ onboarding: หากข้อมูลเป็นความลับ ให้ใช้บน‑prem/ออฟไลน์ หากข้อมูลไม่เสี่ยง ให้อนุญาต Copilot ขององค์กรพร้อมประตูควบคุม และต้องการการลบข้อมูล การลงนาม และการบันทึกการตรวจสอบเสมอ

-

ตัวอย่างจริง: ทีมการตลาดผลิตภัณฑ์ใช้แมโคร AI PowerPoint เพื่อร่างเด็คที่มี placeholders สำหรับข้อมูลลูกค้า การลบข้อมูลถูกนำไปใช้อัตโนมัติ แมโครลงนาม และผู้ตรวจสอบการปฏิบัติตามข้อบังคับตรวจสอบเด็คก่อนที่จะแชร์กับลูกค้า เด็คสุดท้ายถูกเก็บไว้ในโฟลเดอร์ที่จำกัดพร้อมร่องรอยการตรวจสอบครบถ้วน

-

ข้อคิดสำคัญ: ปรับการใช้งาน AI PowerPoint แมโครให้เป็นเวิร์กโฟลว์ที่มีเวิร์กโฟลว์แบบ governance พร้อมประตูควบคุมและ prompts ที่ตรวจสอบได้ เพื่อสร้างท่ออัตโนมัติที่สามารถปรับขนาดได้อย่างปลอดภัย

เชิงผู้เชี่ยวชาญ

-

แนวคิดเน้นการกำกับดูแลก่อน ใคร่ครวญว่า governance ต้องมาก่อน automation ในทางปฏิบัตินี่หมายถึงการกำหนดการจัดประเภทข้อมูล แมโครที่ลงนาม และบันทึกที่ตรวจสอบได้ก่อนเปิดใช้งานการสร้างสไลด์ด้วย AI สำหรับเด็คที่นำเสนอให้ลูกค้า

-

การลบข้อมูลเป็นหลักการออกแบบ ไม่ใช่ขั้นตอนรอง การลบข้อมูลไม่ใช่ขั้นตอนรองในกระบวนการ มันเป็นข้อจำกัดในการออกแบบที่ฝังอยู่ในแมโคร prompts ควรถูกออกแบบเพื่อหลีกเลี่ยงการฝังข้อมูลที่อ่อนไหว โดยมีการลบข้อมูลอัตโนมัติในกระบวนการสร้าง

-

การตรวจสอบได้เป็นคุณลักษณะ ไม่ใช่ผลข้างเคียง กระบวนการที่เข้มแข็งที่สุดมองว่าการโต้ตอบกับ AI ทุกครั้งเป็นเหตุการณ์ที่สามารถตรวจสอบได้ รวมถึง prompts ตัวเลือกโมเดล รหัสแมโคร และการอนุมัติ

-

ความ готовросผ่านนโยบาย ในขณะที่นโยบาย AI ขององค์กรเปลี่ยนแปลง ทีมควรออกแบบเวิร์กโฟลว์ที่ปรับตัวได้อย่างรวดเร็ว — เปลี่ยนจากเส้นทางที่เปิดใช้งาน Copilot ไปสู่เส้นทาง on-prem โดยไม่ต้องมีการเปลี่ยนแปลงกระบวนการมาก

ข้อคิดสำคัญ: ผู้เชี่ยวชาญแนะนำแนวทางที่เน้นการกำกับดูแลก่อน การลบข้อมูลที่เป็นศูนย์กลาง และการตรวจสอบได้ ซึ่งสามารถขยายขีดความสามารถไปพร้อมกับการพัฒนานโยบายและความต้องการขององค์กร

คำถามที่พบบ่อยทั่วไป

-

Is it safe to use AI for client presentations?

-

ใช่ แต่เฉพาะภายใต้เวิร์กโฟลว์ที่ขับเคลื่อนด้วยการกำกับดูแล ใช้การลบข้อมูล โมเดลออฟไลน์/บนสถานที่สำหรับข้อมูลที่อ่อนไหว และ prompts ที่ได้รับการตรวจสอบพร้อมการลงนามแมโคร ความปลอดภัยมาจากการกำกับดูแล ไม่ใช่แค่เครื่องมือเท่านั้น

-

How can I keep confidential data safe when using AI with PowerPoint?

-

จัดหมวดหมู่ข้อมูล ลบข้อมูลที่ละเอียดอ่อน และตรวจสอบให้เงื่อนไขของแมโครและ prompt ป้องกันการรั่วไหล รันกระบวนการ AI ในสภาพแวดล้อมที่แยกออก เก็บผลลัพธ์ไว้ในที่เก็บที่จำกัด และขอการอนุมัติก่อนแบ่งปันเด็คที่นำเสนอต่อลูกค้า

-

What is Copilot in PowerPoint compliance?

-

Copilot ในการปฏิบัติตาม PowerPoint หมายถึงการใช้เวิร์กโฟลว์ที่เปิดใช้งาน Copilot โดยมีประตูนโยบายบังคับใช้งาน ข้อมูลถูกป้องกัน และ prompts ถูกตรวจสอบ อนุญาตเฉพาะเมื่อนโยบายองค์กรได้รับการตอบสนอง มิฉะนั้นให้สลับไปใช้งาน on-prem/offline

-

How do I sign and trust PowerPoint macros?

-

ใช้ลายเซ็นดิจิทัลจากหน่วยงานออกใบรับรองที่เชื่อถือได้ ดูแลที่เก็บแมโครแบบศูนย์กลางที่มีเวอร์ชัน และบังคับให้การดำเนินการตามนโยบายที่อนุญาตให้รันเฉพาะแมโครที่ลงนามแล้วในสภาพแวดล้อมที่ควบคุม

-

What are the risks of AI-generated slides leaking data?

-

ความเสี่ยงรวมถึงการเปิดเผยข้อมูลที่เป็นความลับโดยไม่ตั้งใจผ่าน prompts หรือเนื้อหาที่สร้างขึ้น การรั่วไหลของข้อมูลที่ใช้ในการฝึกโมเดล และข้อมูลที่ออกนอกองค์กรผ่านเครื่องมือที่ทำงานบนคลาวด์ การบรรเทาความเสี่ยงขึ้นอยู่กับการลบข้อมูล การประมวลผลแบบออฟไลน์/on-prem และการควบคุมการเข้าถึงที่เข้มงวด

-

When should I avoid AI in client decks due to policy?

-

หากข้อมูลถูกควบคุม เข้มงวด NDA หรืออาจเปิดเผยข้อมูลลับของลูกค้า ให้เปลี่ยนไปใช้กระบวนการที่ไม่ใช้ AI หรือบน-prem พร้อมการอนุมัติทั้งหมด ความขัดแย้งด้านนโยบายมักกำหนดการตัดสินใจมากกว่าความสามารถทางเทคนิค

-

What workflow can ensure auditability for AI deck creation?

-

บันทึก prompt ทุกตัว รหัสแมโคร และผลลัพธ์ทั้งหมด ต้องการการอนุมัติสำหรับแต่ละเด็ค เก็บร่องรอยการตรวจสอบที่กันการดัดแปลง และรวม prompts โมเดล และลายเซ็นแมโครไว้ในที่เก็บที่มีการกำกับดูแล

-

How can redaction be implemented in AI PowerPoint macro?

-

ฝังขั้นตอนการลบข้อมูลลงในแมโคร ตรวจหาฟิลด์ที่อ่อนไหว แทนที่ด้วย placeholders ที่เป็นกลาง และให้ผู้ตรวจสอบยืนยันเนื้อหาที่ถูกลบก่อนเผยแพร่ภายนอก

-

What about offline/local AI models for PowerPoint?

-

โมเดล AI แบบออฟไลน์/ท้องถิ่นช่วยลดความเสี่ยงจากการเปิดเผยข้อมูล ควรมีการบรรจุ (packaging) ที่เข้มงวด การจัดเก็บโมเดลอย่างปลอดภัย และการกำกับดูแล prompts และผลลัพธ์อย่างเคร่งครัด ควรเชื่อมเข้ากับเวิร์กโฟลว์ที่ตรวจสอบได้

-

How do classification gates work in practice?

-

ประตูการจัดหมวดหมู่เชื่อมข้อมูลประเภทต่าง ๆ กับกฎการดำเนินการในลำดับแมโคร หากเนื้อหามีสถานะ Confidential หรือ Restricted แมโครจะส่งออกเนื้อหาที่ถูกลบข้อมูลและ/หรือบล็อกการแชร์จนกว่าจะได้รับอนุมัติ

-

How to implement least-privilege for macros?

-

รันแมโครด้วยสิทธิ์ขั้นต่ำ จำกัดการเข้าถึงเครือข่าย บังคับให้มีการ whitelist และแยกสภาพแวดล้อมการพัฒนา การทดสอบ และการผลิตของแมโคร เพื่อให้ขอบเขตความเสียหายลดลง

ข้อสรุปจาก Mei Lin: ในจุดตัดของความเร็วของ AI กับความไว้วางใจของลูกค้า กระบวนการสร้างเด็คของคุณควรอ่านเหมือนนิทรรศการที่คัดสรรมาอย่างรอบคอบ—ทุกวัตถุ (ข้อมูล prompts แมโคร) ถูกปกป้องด้วยกรอบที่รอบคอบ (นโยบาย การลบข้อมูล การลงนาม) เมื่อทีมๆ หนึ่งนำเวิร์กโฟลว์ที่โปร่งใสและตรวจสอบได้มาใช้งาน พวกเขาจะเปลี่ยนความกลัวต่อ AI ให้กลายเป็นความมั่นใจในผลลัพธ์ นั่นคือวิธีที่คุณสร้างเด็คที่พร้อมส่งให้ลูกค้าตามจังหวะของแนวคิด โดยไม่ละเมิดความปลอดภัยหรือสัญญา