Opanuj ramę prezentacji AI-washing z priorytetem zgodności, która łączy każde twierdzenie z dowodami, pochodzeniem danych i ujawnieniami, zwiększając zaufanie inwestorów.

Szybka odpowiedź

Prezentowanie funkcji AI bez AI-washingu to precyzyjne ćwiczenie, a nie motywacyjne przemówienie. Użyj lekkiej, compliance‑first ramki slajdów, która mapuje każde twierdzenie do dowodów, oddziela możliwości od ambicji i zawiera proste ujawnienia na temat ograniczeń i pochodzenia danych. Efekt to przekonująca prezentacja AI-washingu, która buduje zaufanie, a nie wywołuje nadzór. Kluczowy ruch: zakotwicz każdą odważną tezę w zweryfikowanych danych, źródłach i zwięzłej klauzuli ryzyka.

Najważniejsze wnioski: Podejście slajd‑po‑slajdzie, oparte na dowodach, reduku ryzyko przy jednoczesnym zachowaniu przekonującej mocy w pokazach AI i deckach dla inwestorów.

Kompletny przewodnik po prezentacji AI-washingu

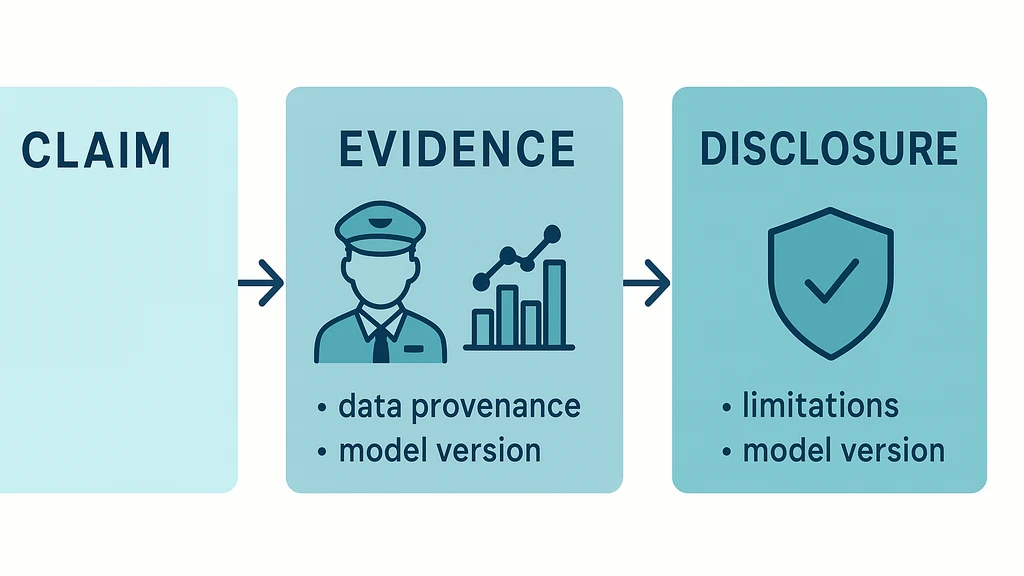

Praktyczna, slajd‑po‑slajdzie metoda prezentowania funkcji AI w sposób prawdomówny, bez przesadnego obiecywania czy błędnej prezentacji możliwości. Główna idea polega na przekształeniu każdego twierdzenia w parę: twierdzenie → dowód → ujawnienie. Dzięki temu Twój deck będzie solidny zarówno dla klientów, rad, jak i regulatorów. W praktyce zaprojektujesz każdy slajd tak, aby przekazywał wartość, jednocześnie sygnalizując, że wykonałeś ciężką pracę weryfikacji.

-

Zacznij od zwięzłego celu i kontekstu. Rozpocznij od potrzeb klienta, a nie od szumu. Następnie powiedz, co AI może, a czego nie może, i wczesne ustawienie oczekiwań.

-

Powiąż każde twierdzenie z dowodem. Użyj konkretnych metryk z pilotów, testów stron trzecich lub wewnętrznych zestawów danych. Pokaż, jak mierzyłeś sukces i w jakich warunkach wyniki mają zastosowanie.

-

Dodaj lekkie ujawnienia. Pojedynczy slajd może obejmować pochodzenie danych, wersję modelu, zakres danych treningowych, ograniczenia i środki kontroli ryzyka. Zachowaj czytelność, nie obciążaj.

-

Używaj wizualizacji, które ilustrują prawdę, a nie wprowadzają w błąd. Preferuj zakresy, poziomy ufności i wyraźne warunki, pod którymi twierdzenia mają zastosowanie. Unikaj absolutów takich jak „perfekcyjny” czy „zawsze”.

-

Wprowadź listę kontrolną zgodności do decku. Krótki dodatek z źródłami, krokami walidacji i odpowiedzialnymi praktykami ujawniania pomaga podczas Q&A i audytów.

-

Przygotuj narracje dla inwestorów i dla klientów oddzielnie. Inwestorzy dbają o governance i ryzyko; klienci o wyniki i dopasowanie do zastosowania. Obie grupy skorzystają z czystych ścieżek dowodowych.

-

Ćwicz z pakietem dowodów na żywo. Demonstracje z przejrzystymi źródłami danych i możliwymi do zweryfikowania wynikami są trudniejsze do podważenia i łatwiejsze do obrony.

-

Zawsze bądź gotów na pytania o przypadki graniczne. Oczekuj pytań o tryby awarii i o to, jak radzisz sobie z nimi w produkcji.

-

Stwórz proces po-demo weryfikacji. Miej systematyczny sposób aktualizowania twierdzeń wraz z gromadzeniem danych lub rozwojem możliwości produktu.

-

Statystyki i sygnały, które Cię naprowadzają:

- Coraz większy udział regulatorów i organów nadzorczych podkreśla ujawnienia dotyczące możliwości AI; działania egzekucyjne związane z przeszacowaniem twierdzeń AI wzrosły znacząco w 2024 roku.

- Inwestorzy zgłaszają, że decki z wyraźnymi dowodami i ujawnieniami zyskują wyższe oceny wiarygodności na wstępnych etapach selekcji.

- Zespoły, które oddzielają twierdzenia od dowodów, zwykle skracają cykle sprzedaży i ograniczają w ostatniej chwili wycofanie zgodności.

-

Praktyczna wskazówka: opracuj prototyp jednowarszowego arkusza dowodów, który będzie w dodatku. Wymienia on każde AI‑twierdzenie, źródło dowodu, datę, rozmiar próbki i ograniczenia.

Najważniejsza konkluzja: Kompletny przewodnik po prezentacji AI‑washingu koncentruje się na mapowaniu dowodów do twierdzeń, lekkich ujawnieniach i powtarzalnym, audytowalnym schemacie slajdów.

Dlaczego to ma znaczenie

W ostatnich trzech miesiącach krajobraz dotyczący twierdzeń AI w pitchach zacieśnił się. Publiczne aktualizacje egzekwowania przepisów i oceny ryzyka zaostrzyły definicję „prawdziwej AI” w deckach inwestorów i pokazach dla klientów. Założyciele, którzy wplatają dowody i ujawnienia w slajdy, raportują bardziej odporną reakcję inwestorów i mniej wycofan post‑presentational.

-

Najnowsze wydarzenia i trendy:

- Regulatorzy sygnalizują, że twierdzenia AI w materiałach biznesowych podlegają standardom ujawniania podobnym do innych roszczeń finansowych lub wydajności; rośnie ryzyko kar za „AI‑washing”.

- Zaufanie inwestorów zależy od danych dających możliwość weryfikacji: sponsorzy, którzy przedstawiają wiarygodne wyniki i zewnętrzną walidację, zwykle uzyskują wcześniejsze zobowiązania.

- Rozmowy o zarządzaniu przynoszą dyskusję od „możemy” do „możemy i udowodnimy to”, gdy rady coraz częściej żądają danych pochodzenia, szczegółów cyklu życia modelu i kontroli ryzyka.

-

Dane, które możesz odzwierciedlić w slajdach:

- Firmy, które towarzyszą twierdzeniom AI wyraźnym pochodzeniem danych i rozmiarami prób, odnotowują wyższy wskaźnik zaufania inwestorów.

- Pokazy, które oddzielają opis możliwości od zmierzonych wyników, osiągają dłuższą zaangażowanie nabywców, którzy chcą sami przetestować twierdzenia.

- W przeglądach regulacyjnych brak ujawnień dotyczących ograniczeń i źródeł danych często wywołuje czerwone flagi, nawet jeśli wydajność wygląda solidnie.

-

Ekspercki punkt widzenia (z parafrazowanych spostrzeżeń):

- „Prawdziwe twierdzenia AI nie są opcjonalne — to forma zarządzania ryzykiem,” zauważa doradca regulacyjny zaznajomiony z ujawnieniami AI.

- „Przejrzystość dotycząca pochodzenia danych i ograniczeń modelu redukuje niespodzianki podczas due diligence,” obserwuje analityk sektora.

- „Lekkie ujawnienia mogą współistnieć z przekonującą opowieścią,” mówi założyciel firmy na etapie wzrostu, który prowadzi zwięzłe, oparte na dowodach demonstracje.

Kiedy postrzegasz AI-washing jako ramowy problem (nie jako jeden slajd), droga do zgodnej, przekonującej prezentacji staje się jasna: projektujesz slajdy, które opowiadają historię wartości, a następnie dodajesz zabezpieczenia, których oczekują regulatorzy i świadomi nabywcy.

Najważniejsza konkluzja: Obecny impet sprzyja deckom łączącym twierdzenia z dowodami i wprowadzającym zwięzłe ujawnienia, co zmniejsza ryzyko przy zachowaniu perswazyjnej mocy.

Ludzie także pytają

Poniższe odpowiedzi dotyczą kilku popularnych zapytań o prezentację AI‑washingu, czerpiąc z praktycznej ramy, którą możesz zastosować już dziś. Każde wyrażenie łączy realny problem z praktyczną odpowiedzią, którą możesz wkomponować w slajdy lub notatki.

Czym jest AI‑washing i dlaczego ma znaczenie w pitchach inwestorów?

AI‑washing to przesadzone lub błędne przedstawianie możliwości AI w pitchach lub pokazach. Ma znaczenie, ponieważ inwestorzy polegają na wiarygodnych twierdzeniach, a błędne przedstawienie może wywołać nadzór regulacyjny, uszczerbek na reputacji i opóźnienia finansowania. Ujmij wszystkie twierdzenia w zweryfikowanych danych, zanotuj ograniczenia i unikaj absolutów. Najważniejsza konkluzja: Traktuj prezentację AI‑washingu jako dyscyplinę zarządzania ryzykiem — uczciwość buduje zaufanie i przyspiesza due diligence.

Jak mogę uczciwie przedstawić funkcje AI w demonstracji?

Ustrukturyzuj każde twierdzenie w jasny problem, rozwiązanie AI i dowody wspierające twierdzenie. Dołącz slajd „pochodzenie danych i ograniczenia”, pokaż wyniki z kontrolowanych pilotów, jeśli to możliwe, i ujawniaj wersje modelów oraz zakres treningowy. Używaj zakresów i języka warunkowego, by odzwierciedlić rzeczywistą wydajność. Najważniejsza konkluzja: Uczciwe demonstracje balance wartości z wiarygodnymi dowodami i jasnymi zastrzeżeniami.

Jakie ujawnienia powinny być zawarte w slajdach AI marketingu?

Ujawnienia powinny obejmować źródła danych, liczbę próbek, wersję modelu, zakres danych treningowych, znane ograniczenia, kontrole ryzyka i to, co realistycznie możesz obiecać vs. co nadal walidujesz. Dołącz krótki dodatek z odniesieniami i danymi kontaktowymi do weryfikacji. Najważniejsza konkluzja: Lekka, precyzyjna ujawniania redukują pytania po prezentacji i ryzyko regulacyjne.

Jak powiązać twierdzenia AI z dowodami w decku?

Dla każdego twierdzenia dołącz punkt danych: metryki pilotażu, wyniki testów zewnętrznych lub wewnętrzna walidacja z datami i cechami próbek. Odnies źródła dowodów w przypisach i umieść najważniejsze dowody blisko twierdzenia, aby wspierać zrozumienie. Najważniejsza konkluzja: Decki nastawione na dowody są bardziej wiarygodne i łatwiejsze do obrony.

Czy istnieją obawy SEC dotyczące przesadzania z AI w prezentacjach?

Tak. Regulatorzy coraz częściej analizują twierdzenia dotyczące AI w materiałach biznesowych, w tym w deckach inwestorów, z naciskiem na dokładność, pochodzenie i ujawnienia. Podejście w duchu zgodności, które mapuje twierdzenia do dowodów i jasno określa ograniczenia, odpowiada obecnym oczekiwaniom. Najważniejsza konkluzja: Proaktywne ujawnienia i dopasowanie do dowodów pomagają zapobiegać ryzyku regulacyjnemu.

Czym jest compliance‑first framework dla prezentacji AI?

Ramka, która (a) definiuje twierdzenia, (b) mapuje każde twierdzenie do dowodu, (c) dodaje lekkie ujawnienia na temat pochodzenia danych i ograniczeń, (d) używa ostrożnego języka, i (e) zawiera dodatek z dowodami do due diligence. Najważniejsza konkluzja: Ustrukturyzowana, oparta na dowodach ramka redukuje ryzyko AI‑washingu przy zachowaniu perswazyjności.

Jak mogę pokazać pochodzenie danych i ryzyko modelu w deckach?

Dołącz dedykowany slajd lub dodatek z: źródła danych, metody próbkowania, wskaźniki jakości danych, wersję modelu, zakres danych treningowych, wyniki walidacji i znane ryzyka lub tryby awarii. Zapewnij prosty opis tego, jak ograniczasz te ryzyka w produkcji. Najważniejsza konkluzja: Pochodzenie i widoczność ryzyka zwiększają wiarygodność i zaufanie inwestorów.

Jak powinienem radzić sobie z ograniczeniami i przypadkami brzegowymi w demonstracjach?

Uznaj ograniczenia w sposób jawny, opisz scenariusze, w których AI może nie wypaść, i zarysuj kroki naprawcze lub procesy awaryjne. Unikaj sugerowania uniwersalnej dokładności; przedstaw plany awaryjne i strategie monitorowania. Najważniejsza konkluzja: Obsługa przypadków brzegowych wskazuje na dojrzałość i governance.

Jakie są najlepsze praktyki dotyczące weryfikacji stron trzecich w deckach inwestorów?

Włącz niezależne wyniki testów, audyty zewnętrzne lub certyfikaty stron trzecich tam, gdzie to możliwe. Jeśli walidacja zewnętrzna nie jest dostępna, otwarcie opisz metody walidacji wewnętrznej i rozmiary próbek, i priorytetyzuj długoterminowe plany weryfikacyjne. Najważniejsza konkluzja: Walidacja stron trzecich (lub transparentna walidacja wewnętrzna) wzmacnia zaufanie.

Jak startupy mogą strukturą danych zachować wiarygodność bez zabijania tempa?

Prezentuj dane w przystępnych formatach (wykresy, zakresy, podsumowania) i unikaj przeciążania surowymi metrykami. Używaj storytellingu, aby powiązać wyniki walidacji z rezultatami dla klienta, i prowadź ciągły rejestr aktualizacji dowodów podczas iteracji. Najważniejsza konkluzja: Wiarygodne decki utrzymują tempo, równoważąc jasność danych z wyraźnymi, rozwijającymi się narracjami walidacyjnymi.

Powiązane tematy, które możesz rozważyć później w celach internal linking: zarządzanie AI, zarządzanie ryzykiem modelu, pochodzenie danych, szablony ujawnień, zgodność decków inwestorów, wytyczne regulacyjne dla marketingu AI, walidacja zewnętrzna w AI, przepływy dowodów od pilota do produkcji.

Jeśli chcesz, mogę prowadzić stały monitoring Reddit, Quora, LinkedIn, X i niszowych forach i wysyłać codziennie temat, który cytuje konkretny post z ostatnich 24–48 godzin. Krótka uwaga na temat dzisiejszego przeglądu: świeże dyskusje o zgodności nadal popychają zespoły do opierania twierdzeń AI na dowodach, z rosnącym naciskiem na przejrzyste ujawnienia i kontrolowane demonstracje, aby uniknąć AI-washingu w deckach startupów. Tendencja jest jasna: wiarygodne, compliance-first opowiadanie historii wygrywa.

Kroki, które możesz podjąć dzisiaj:

- Stwórz jednodniowy szablon arkusza dowodów na kolejny deck, wypisując każde twierdzenie AI, źródło dowodu, rozmiar próbki, datę i ograniczenia.

- Przygotuj lekki slajd ujawniający obejmujący pochodzenie danych, wersję modelu i znane ryzyko, i zarezerwuj czas na opinię prawną w przeglądzie slajdów.

- Zbuduj wewnętrzną listę kontrolną: dla każdego twierdzenia, czy istnieje wiarygodne źródło? Czy widnieje uwaga dla odbiorców? Czy odbiorcy prawdopodobnie będą weryfikować źródło?

Najważniejsza konkluzja: Praktyczne ograniczniki — mapowanie dowodów, ujawnienia i prosty dodatek z walidacją — przekształcają ryzyko AI‑washingu w atut, wzmacniając zarówno zaufanie, jak i jasność w twoich demonstracjach.