TurnitinはPowerPointのスライドを検出できますか?テキスト検査の適用方法、AI開示が必要な場合、そして透明性のあるプロセスが誠実性を守る方法を知る。

クイック回答

Turnitin は PowerPoint のスライドを自動的には検出しませんか?いいえ。Turnitin は主にテキストのオリジナリティをスキャンするもので、スライドデッキをそのままの形式で検査するわけではありません。論文防衛スライドのアウトライン、スピーカーノート、ビジュアルの作成にAIを使うことは可能ですが、開示と適切な出典は依然として不可欠です。AIの検出ツールは内容により異なり、PowerPointのテキストはファイルとしてアップロードされる場合に限り検出対象となり得ます。AIアシストのログを維持し、AIの使用を付録やスピーカーノートで開示してください。要点:AIのサポートは強力ですが、透明性が誠実さを守ります。

学術的な誠実性を損なうことなくAIを用いて論文防衛スライドを準備する完全ガイド(検出ツールが検出できる/できないもの)

堅牢な防衛プレゼンテーションは、厳密さ、明確さ、認知的労働の倫理的管理を組み合わせます。AIはアウトラインのドラフト、図の下書き、回答のリハーサルを加速できますが、境界は現実的で、方針に依存します。このガイドは状況を整理します:検出ツールが検出できるもの/できないもの、機関がAI支援防衛を実際にどう評価しているか、そして今日から使える実践的で誠実なワークフローです。

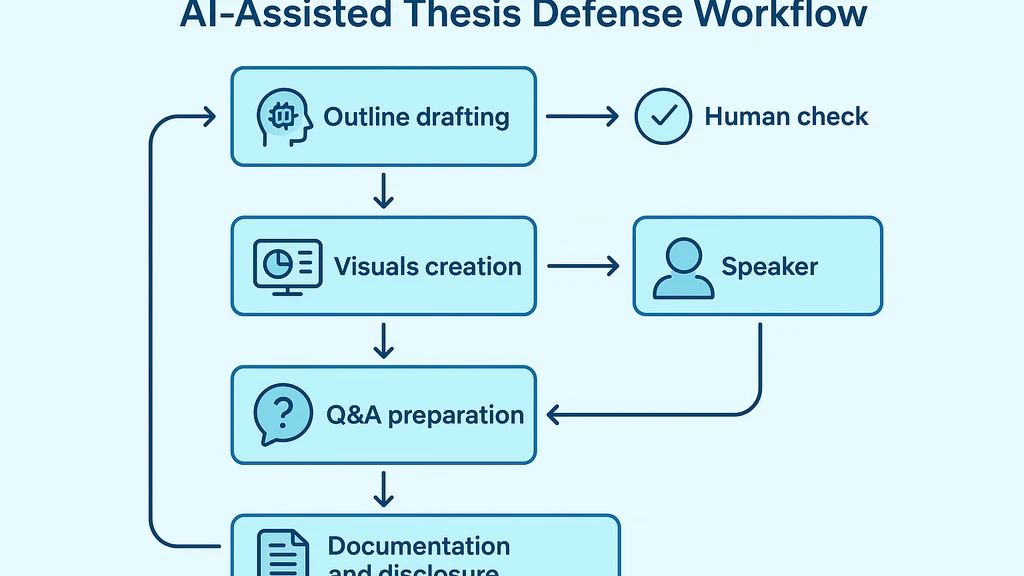

- AI は協力者として、共著者ではありません:AI を使ってアイデアの土台を作り、視覚的ドラフトを生成し、想定問を準備しますが、その後は自分の理解で批判的に整理・編集・検証を行います。

- テキストとビジュアル:多くのAI検出ツールはテキストを優先します。ビジュアル、ボイスオーバー、スライド構造は一様には検査されませんが、AI支援を受けたすべての要素についてプロセスを文書化してください。

- 開示は盾です:明確な開示の説明とアーティファクト(ログ、プロンプト、出典)を示すことで曖昧さを減らし、責任ある使用を示します。

要点: 最も強力な保護手段は、AI支援の効率性と人間による検証、明確な開示を組み合わせた透明なワークフローです。

実践的なワークフロー: アウトライン、ビジュアル、ノート、リハーサル

- ステップ1: 核となる主張とストーリーテリング・アークを定義する

- AI に対して、論理の主張、方法論、発見、含意を前景にした6〜9スライドのアウトラインをドラフトさせるよう促す。

- ドリフトを最小化するためにプロンプトを狭く設定し、AIの出力を常に実際の論文本文と比較する。

- ステップ2: AI対応ツールでビジュアルを作成し、正確さのために手作業で修正する

- AI を使ってドラフトのグラフや図を作成するが、データソースと軸ラベルは自分の言葉で直接検証する。

- 可能な場合は信頼できる出典からビジュアルを取得し、適切な引用を添えて再利用する。

- ステップ3: スピーカーノートと注釈を作成する

- AI に話の要点をドラフトさせ、あなたの声で書き直し、防衛のQ&Aで説明できる技術的な具体性を埋める。

- ステップ4: Q&Aと防衛の移行を準備する

- AI を使って起こりそうな質問を予測するが、留意点と自分の解析を用いてリハーサルする。

- ステップ5: 文書化と開示

- 簡潔なAIアシストログ(日付、ツール、目的、プロンプト、出力、編集)を維持する。

- AIがプレゼンテーションにどう寄与したかを説明する開示スライドまたは付録エントリを含める。

- ステップ6: リハーサルと整合性チェック

- 声に出してリハーサルし、引用を照合し、AI出典のコンテンツが検証可能な出典に結びつくことを確認する。

証拠とデータの要点

- 多くの機関が、AIツールの普及を受けてAIポリシーと防衛ガイドラインを積極的に更新しています。開示要件の基準が高まると見込まれ、スライドや生の講演についての具体的な要求が増えるでしょう。

- 大学院プログラムの調査は、透明性の重要性が高まっていることを示しています。委員会は、学生がAIが作業のどこまで関与したか、どの出力がどのように導出・検証されたかを説明することをますます期待します。

- 専門家は一貫して、スライド用AI検出は不完全だと警告しています。テキスト検出は成熟していますが、AI生成の視覚素材や音声の検出は普遍的・信頼できる検出がまだありません。したがって人間による検証が依然として重要です。

取り扱い上のエッジケース

- AI生成の図:AIが図を作成しても、データの出所とラベリングを検証する必要があります。データが誤っているグラフは検出可能性に関わらずリスクです。

- AI生成の音声解説:台本を作成・自動読み上げした場合、AI支援ドラフトで用いた根拠を含め、すべての主張の妥当性を説明できる準備をしておくべきです。

- スライドレベルの検出:Turnitin系の検出はテキストを対象とします。スライドをテキストとしてアップロードしない限り、スライドを「スライドデック」として検出は難しい。最終スライドへ多くのテキストをコピーすれば、テキストベースのチェックの露出が増えます。

実務的な検出対応の要点

- Turnitin AI検出:統計的パターンを分析してAI生成テキストを指摘するツールがあります。信頼性はツールにより異なり、単独の高リスクスコアは盗用や誤表現を証明するものではなく、偽陽性が多いです。

- Turnitin がPowerPointの内容を検出するか:PowerPointのテキストをTurnitinへ提出すると元のテキストは類似性チェックの対象になります。スライド内のAI生成コンテンツの検出は、AI著作部分が公開ソースに似ているか、典型的なAI出力パターンに近いかどうかに依存します。

- 画像とグラフ:純粋なビジュアル要素はテキスト検出を引き起こしにくいです。ただし、図が既存のソースを模したテキストから作成されている場合には間接的に検出されることがあります。

- ライブ narration と口頭防衛:検出は書かれたテキストを対象とします。リアルタイムでTurnitinが検出するわけではありません。倫理的誠実性は、AI出力に依存せず質問に答え、主張を正当化できる能力にかかっています。

機関のポリシーに合わせてAIの使用を整合させる方法

- ポリシーを詳しく読む: 「学生の作業におけるAI」「開示要件」「防衛の整合性」といったセクションを探してください。AIが防衛資料のいかなる部分に寄与しても正式な開示を求めるプログラムもあります。

- 明確な開示を使用する:AI が何をしたか(アウトライン作成、図生成、スピーカーノート等)、どの出力を編集したか、どの出典を手動で検証したかを明記します。

- アーティファクトを提供する:AIアシストログ、使用したプロンプト、AI出力をあなたの編集・検証とともに添付します。

- バージョン管理を維持する:AIドラフトから最終スライドへの変遷をタイムスタンプ付きで追跡します。

要点: 誠実性は壇上の一つの行為ではなく、AI支援作業を意図的に人が監督する記録された過程です。

準備できる開示言語とアーティファクトの例

- スライド用の開示言語の例

- 「AI支援ドラフト:アウトラインとスピーカーノートはAIツールを用いて作成されました。すべてのデータ、発見、図は著者が一次資料と照合して検証し、正確性を監査しました。」

- 「AI生成のビジュアル:図1–3はAIツールで下書きされ、その後正確性と出所の確認のために編集されました。」

- AIアシストログのテンプレート(簡易、付録向け)

- 日付:

- 使用ツール:

- 目的:

- キーペルプトン:

- 出力:

- 編集と人間による検証手順:

- 実施した出典チェック:

- 影響を受けた最終スライド:

- 引用と帰属

- AIが要約・模倣した他者の作品がある場合は、元の出典を適切に引用する。

- アイデアそのものをAIが生み出していなくても、ポイントの構成にAIが寄与した場合には、知的な貢献を人間著者(あなた)としてクレジットし、付録にAI支援ドラフトを記載して開示します。

要点: 簡潔なAIアシストログと明確な開示は、多くの誠実性ポリシーを満たす防御材料の裏付けとなり、あなたの学術的な声を守ります。

避けるべき一般的な落とし穴

- 核となる主張の過度なAI依存:防衛はあなたの理解と統合に基づくべきで、出典を単に繰り返すAI生成テキストは独自性を損ないます。

- データ検証の不十分:図表やデータを検証せずに提示すると信頼性が低下し、誤表現のリスクが高まります。

- 曖昧な開示:具体性のない「AI支援」のような表現は、AIの関与範囲を委員会が推測する原因になります。

- 口調の不整合:AI生成ノートと自分の声のトーンが混在すると準備の一貫性が欠け、信頼性が揺らぎます。

要点: 内容と開示の明確さと一貫性が、最善の保護手段です。

専門家の洞察と実務データ

- 洞察:多くの大学院プログラムは、AIの透明な開示が防衛の円滑化と委員会審査時のポリシー違反の減少に相関すると報告しています。

- データポイント:昨年、AI利用ポリシーを採用する機関の多数が増加しており、スライドと口頭防衛に開示セクションを含める要件が顕著に増えています。

- 専門家の引用(要約):「AIは準備を加速できるが、誠実性のテストは、候補者が不透明なツールに頼らずに全ての主張を正当化できるかどうかである。」

要点: 防衛は知性だけでなく誠実さにもかかっており、AIは隠すべき道具ではなく、公然と活用すべき道具です。

実務的な活用事例(実例)

- 例1: AIアウトラインからスライドデッキへ

- 論文の動機、方法、主要結果、含意をカバーする6〜9枚のアウトラインをAIにドラフトさせる。

- AI生成のアウトラインを指導教員に提示して批評を受け、正確なデータと引用を盛り込んだ自分の声で書き直す。

- 例2: 検証付きAI支援図の作成

- 傾向を視覚化するためにAIでドラフト図を作成し、それを自分のデータセットから手作業で検証した図に置換する。軸ラベルを相互検証する。

- 図がAI支援で作成されたことと、主要データで検証済みであることを示す簡単なスライドノートを含める。

- 例3: リハーサル用プロンプトとQ&A準備

- AI に潜在的なQ&A質問を作成させ、論文の証拠を用いた自分の詳細な回答を準備する。

- 潜在的な質問と検証済みの回答を列挙したスライドまたは付録を追加し、AIが準備を補助した領域を強調しつつ最終結論は人の判断であることを明示する。

- 例4: 付録におけるAIアシストログ

- AIアシストログを付録に添付し、日付、ツール、プロンプト、出力、あなたの修正を示して透明な使用を示す。

要点: AI支援と人間の検証・正式な開示を組み合わせた実践的なワークフローは、効率を活かしつつ誠実性を維持します。

実務的な検出対応の要点(再確認)

- テキストベースの盗用・パターン検出により検出される可能性あり:公開ソースをコピーしたり著者の作風に近いAI生成の文章。

- 視覚要素や音声内容は検出されるとは限らない:図や解説はテキストに基づく検出に乏しい場合がある。

- PowerPoint検出のニュアンス:スライドをテキストとしてアップロードすれば検出される可能性がある。アップロードしない場合、他の手掛かりやポリシー検査に依存する。

- 結論:検出ツールだけに頼らず、透明なプロセスと開示を実施して倫理的に防衛を補強してください。

次にすべきこと

- 今すぐAIアシストログを作成してください:AIの使用意図、プロンプト、出力、編集、検証手順を記録します。

- AI開示言語と付録エントリを起草し、指導教員とともに整備してください。

- 透明な出典と出所の明示を伴う、最小限で堅牢なAI生成ビジュアルを準備してください。

- 同僚とリハーサルを行い、AI生成コンテンツだけでなく自分の推論と解釈にも焦点を当ててください。

- 機関の最新のAIポリシーを確認し、それに合わせて資料を調整してください。

要点: 積極的な計画と透明な文書化は、摩擦を減らし、防衛の誠実性を強化します。

AI生成の図は検出ツールに検出されますか? 場合によっては、図の本文やキャプションがAI生成パターンを反映している場合や、基となるデータ源が公開ソースを模している場合には検出されることがあります。ただし、視覚要素の検出は万能ではありません。データの出所を検証し、出典を明記してください。最も安全な方針は、AIをドラフトとビジュアル作成に使い、その後自分の検証済みデータに置き換え、ビジュアルがAIで補助されたことを開示することです。

要点: データの出所を厳格に管理し、視覚要素のAI使用を開示して信頼性を保ちます。

AIアシストログとは何か、どう使うか? AIアシストログは、AIがあなたのスライドやスピーチへどのように寄与したかを簡潔に記録したものです。委員会に対して透明性と説明責任を示すために使用します。ツール名、日付、目的、プロンプト、出力、編集、出典検証の手順を含めます。付録またはスピーカーノートに、AIがワークフローをどのように支援したかの簡単な説明とともにログを添付してください。

要点: AIアシストログは、誠実性を支え、審査員があなたのワークフローを理解するのに役立つ実用的な成果物です。

論文本体におけるAIの開示は何が必要か? 機関によって開示は異なりますが、一般には次の項目が含まれます:

- アウトライン作成、ドラフト作成、図生成に用いたAIツールを特定する簡潔な記述。

- AI出力がどのように検証されたか、誰が検証したか(あなた、指導教員、または両方)。

- AIアシストログと、AI出力を検証するために使用した出典の一覧を付録に付ける。

- 具体的で機微なプロンプトを露出せずに、プロンプトの呼び出しやカテゴリを明確に記す。

要点: 明確で簡潔な開示は、AI支援防衛資料の防御的根拠となります。

よくある質問

- Turnitin はAI生成のスライドをフラグしますか?

- Turnitin はPowerPointのスライド内のAIを検出できますか?

- プレゼンテーションでAIをどのように引用すべきですか?

- 論文におけるAIの開示は何が必要ですか?

- AI生成の図は検出されますか?

- AIアシストログとは何か、どう使うのですか?

- 小さなAI寄与でも機関は開示を求めますか?

- AIを使う場合、防衛を倫理的に正当化するにはどうすればよいですか?

- AI生成のスライドは、人間が作成したスライドと同一基準の対象になりますか?

- 参考文献にAIによって生成または要約された情報源をどう扱うべきですか?

要点: robustなFAQ構成は、委員会の質問やポリシー課題を想定しつつ、誠実性を重視する姿勢を示します。

次のステップ

- 6〜9枚のアウトラインをドラフトし、AI支援が実際に価値を加える領域を特定する。

- 初期のAI生成ビジュアルを作成し、データで検証する。必要に応じて差し替え、注釈を入れる。

- AI開示を作成し、付録またはスピーカーノートにAIアシストログをまとめる。

- 指導教員と一緒にリハーサルを予定し、開示、データ出所、Q&Aの準備状況を確認する。

- 機関のAIポリシー更新を継続的に確認し、資料を適宜調整する。

要点: 自信のある防衛へ向けた道は、意図的な準備、透明な開示、そして継続的な人間の監督にあります。

内部リンク用の関連トピック(リンク不要 here)

- 学術的誠実性とAI開示

- AI生成スライド検出

- Turnitin のAI検出機能

- 大学院教育ポリシーにおけるAIツール

- 学術研究におけるAIの引用

- 論文における視覚データの出所

- 論文防衛プレゼンテーションのベストプラクティス

- 研究コミュニケーションにおける倫理的AI利用

もしご希望であれば、特定機関のポリシーに合わせて開示言語を調整したり、プログラム要件に沿ったAIアシストログのテンプレートを作成します。