Ovládněte rámec prezentace AI-washingu zaměřený na dodržování předpisů, který mapuje každé tvrzení na důkazy, původ dat a zveřejnění, čímž posiluje důvěru investorů.

Krátká odpověď

Prezentování funkcí AI bez AI-washingu je cvičení přesnosti, nikoli motivační řeč. Použijte lehký rámec slidů s pořádkem v souladu s předpisy, který mapuje každé tvrzení na důkazy, odděluje schopnost od ambice a zahrnuje jednoduchá zveřejnění o mezích a původu dat. Výsledek je přesvědčivá prezentace o AI-washingu, která buduje důvěru, místo aby vyvolávala dohled. Klíčový krok: pevně ukotvěte každé odvážné tvrzení k ověřitelným datům, zdrojům a jasnému prohlášení o rizicích.

Hlavní zjištění: Postup po slajdech s důkazy na každém kroku snižuje riziko a zároveň zachovává přesvědčivost v ukázkách AI a prezentacích pro investory.

Kompletní průvodce prezentací AI-washingu

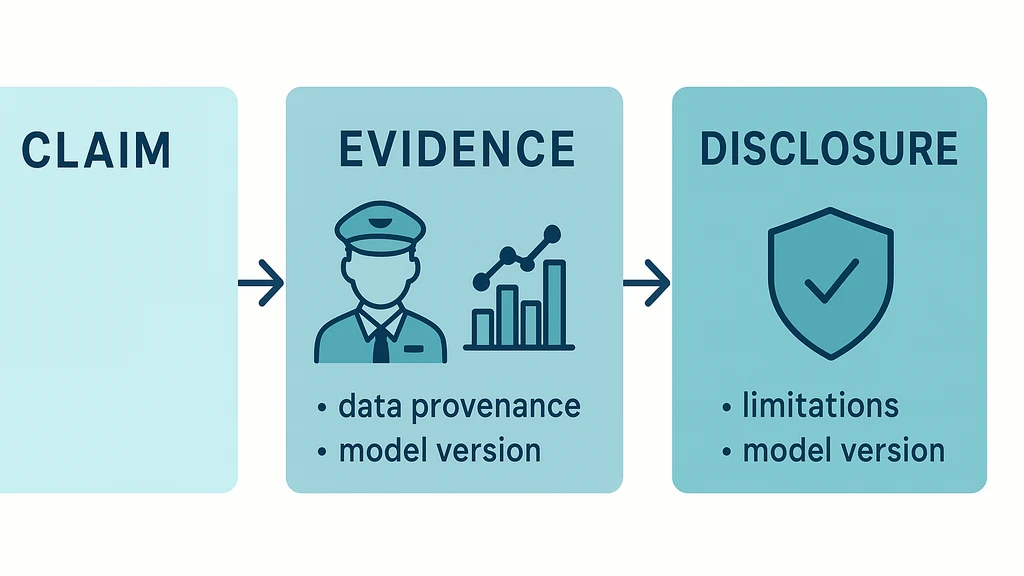

Praktická metoda, která jde slide po slidu, jak pravdivě prezentovat funkce AI, aniž byste slibovali víc, než lze dokázat, či zkreslovali schopnosti. Jádro myšlenky spočívá v tom, že každé tvrzení proměníte v dvojici: tvrzení → důkazy → zveřejnění. To vaši prezentaci učiní robustní pro zákazníky, správní rady a regulátory. V praxi navrhnete každý snímek tak, aby komunikoval hodnotu a zároveň signalizoval, že jste odvedli tvrdou práci ověření.

-

Začněte stručným cílem a kontextem. Otevřete s potřebou zákazníka, ne s reklamou. Poté uveďte, co AI může a nemůže dělat, a stanovte očekávání již na začátku.

-

Všechny tvrzení spojte s důkazy. Použijte konkrétní metriky z pilotních projektů, testů třetích stran nebo interních datových sad. Ukažte, jak jste měřili úspěch a za jakých podmínek výsledky platí.

-

Zahrňte lehká zveřejnění. Jeden snímek může pokrýt původ dat, verzi modelu, rozsah tréninkových dat, omezení a mechanismy řízení rizik. Držte to čitelné, ne zátěžné.

-

Používejte vizuály, které osvětlují, ne klamou. Preferujte rozmezí, úrovně důvěry a jasné podmínky, za kterých platí tvrzení. Vyhýbejte se absolutům jako „dokonalé“ či „vždy“.

-

Vytvořte rámec shody do prezentace. Krátká příloha se zdroji, validačními kroky a odpovědným zveřejněním pomáhá během Q&A a auditů.

-

Připravte příběhy pro investory a zákazníky zvlášť. Investoři se zajímají o governance a riziko; zákazníci o výsledky a vhodnost použití. Oba těží z čistých stop důkazů.

-

Procvičujte s živým balíčkem důkazů. Demonstrace, které obsahují transparentní zdroje dat a ověřitelné výsledky, se hůře napadají a snadněji se brání.

-

Vždy buďte připraveni na otázky o okrajových případech. Očekávejte dotazy ohledně režimů selhání a jak s nimi zacházíte v produkci.

-

Vytvořte proces po demonstračním vystoupení pro ověření. Mějte systematický způsob aktualizace tvrzení podle nárůstu dat nebo vývoje schopností produktu.

-

Statistiky a signály, které vás povedou:

- Rostoucí podíl regulatorů a dozorčích orgánů klade důraz na zveřejňování kolem AI schopností; sankční opatření související s nadsazeným tvrzením o AI vzrostla v roce 2024.

- Investoři uvádějí, že prezentace s jasnými důkazy a zveřejněními získávají vyšší důvěryhodnost při počátečním hodnocení.

- Governance rozhovory se posouvají od „můžeme“ k „můžeme a dokážeme to prokázat“, přičemž představenstva čím dál častěji žádají o původ dat, detaily životního cyklu modelu a řízení rizik.

-

Praktický tip: vytvořte prototyp jedné strany listu důkazů, který zůstane v příloze. Uvádí každé tvrzení o AI, zdroj důkazu, datum, velikost vzorku a omezení.

Hlavní zjištění: Kompletní průvodce prezentací AI-washingu se soustředí na mapování důkazů k tvrzením, lehká zveřejnění a opakovatelný, auditně snadno ověřitelný rámec slidů.

Proč na tom záleží

V posledních třech měsících se prostředí kolem tvrzení o AI v prezentacích zpřísnilo. Veřejné zásahy do dodržování pravidel a hodnocení rizik zlepšily definici „pravdivého AI“ v investičních prezentacích a ukázkách pro zákazníky. Zakladatelé, kteří vkládají důkazy a zveřejnění do slidů, hlásí odolnější přijetí ze strany investorů a méně stažených materiálů po prezentaci.

-

Nedávný vývoj a trendy:

- Regulátoři signalizovali, že tvrzení o AI v prezentacích a ukázkách podléhají standardům zveřejnění podobným těm u jiných finančních či výkonnostních tvrzení; riziko sankcí za „AI-washingu“ stoupá.

- Důvěra investorů závisí na dohledatelných datech: sponzoři, kteří prezentují ověřitelné výsledky a třetí stranou ověřenou validaci, obvykle získávají dřívější závazky.

- Diskuze o řízení se posouvají od „můžeme“ k „můžeme a dokážeme to prokázat“, přičemž představenstva stále častěji žádají o původ dat, detail životního cyklu modelu a kontrolu rizik.

-

Data, která můžete reflektovat ve slajdech:

- Společnosti, které doprovází tvrzení o AI jasným původem dat a velikostmi vzorků, mají vyšší důvěryhodnost investorů.

- Ukázky, které oddělují popis schopností od měřených výsledků, dosahují delšího zapojení kupujících, kteří chtějí tvrzení sami otestovat.

- Při regulačních hodnoceních chybějící zveřejnění omezení a zdrojů dat často vyvolává červené vlajky, i když výkonnost vypadá silně.

-

Pohled odborníků (parafrázované poznatky):

- „Pravdivá AI tvrzení nejsou volitelná – jsou formou řízení rizik,“ poznamenává regulativní poradce obeznámený s AI zveřejňováním.

- „Transparentnost ohledně původu dat a omezení modelu snižuje překvapení během due diligence,“ říká analytik z odvětví.

- „Lehká zveřejnění mohou koexistovat s přesvědčivým vyprávěním,“ říká zakladatel ve fázi růstu, který vede tvrdá, důkazy řízená demonstrační dema.

Když na AI-washingu pohlížíte jako na rámcový problém (ne jako na jeden snímek), cesta k shodné, přesvědčivé prezentaci se stává jasnou: navrhujete snímky, které vypráví příběh o hodnotě, a poté vrstvením zabezpečení, která regulátoři a zkušení kupci očekávají.

Hlavní zjištění: Současný trend upozaďuje prezentace, které spojují tvrzení s důkazy a začleňují stručná zveřejnění, čímž snižují riziko, zatímco zachovávají přesvědčivou sílu.

Lidé se také ptají

Následuje několik běžných dotazů kolem prezentace AI-washingu, vycházejících z praktického rámce, který můžete dnes použít. Každý bod spojuje reálný problém s konkrétní odpovědí, kterou můžete vložit do svých slidů nebo poznámek.

Co je AI-washing a proč na tom záleží v pitchích pro investory?

AI-washing je nadsazování nebo zkreslování schopností AI v pitchích či ukázkách. Záleží na tom, že investoři spoléhají na důvěryhodná tvrzení, a klamavé tvrzení může vyvolat regulatorní dohled, poškození pověsti a zpoždění financování. Základ všech tvrzení na ověřitelných datech, uveďte omezení a vyhněte se absolutům. Hlavní zjištění: Přistupujte k prezentaci AI-washingu jako k disciplíně řízení rizik: upřímnost buduje důvěru a urychluje due diligence.

Jak mohu prezentovat funkce AI pravdivě v demonstraci?

Strukturujte každé tvrzení s jasným problémem, řešením AI a důkazy podporující tvrzení. Zařaďte slide „původ dat a omezení“, ukažte výsledky z řízených pilotů, když je to možné, a zveřejněte verze modelů a rozsah tréninku. Používejte rozmezí a podmíněný jazyk, aby odrážel real-world výkon. Hlavní zjištění: Pravdivé demo vyvažuje hodnotu s ověřitelnými důkazy a jasnými výhybkami.

Jaké zveřejnění by mělo být zahrnuto v marketingových slidách AI?

Zveřejnění by měla pokrýt zdroje dat, velikosti vzorků, verzi modelu, rozsah tréninkových dat, známá omezení, řízení rizik a to, co můžete realisticky slíbit vs. co ještě ověřujete. Přidejte stručný dodatek s odkazy a kontaktními údaji pro ověření. Hlavní zjištění: Lehká, přesná zveřejnění snižují počet dotazů po prezentaci a regulatorní riziko.

Jak spojím tvrzení o AI s důkazy v prezentaci?

Pro každé tvrzení přiřaďte údaj: metriky pilotů, výsledky testů třetích stran nebo interní validaci s daty a charakteristikami vzorků. Uveďte zdroje důkazů v poznámkách pod čarou a umístěte nejpřesvědčivější důkazy blízko tvrzení. Hlavní zjištění: Důkazy dopředu zvyšují důvěryhodnost a lépe se brání.

Mají obavy SEC ohledně nadsazování AI v prezentacích?

Ano. Regulátoři se čím dál tím více zaměřují na tvrzení o AI v obchodních materiálech, včetně investor decků, s důrazem na přesnost, původ dat a zveřejnění. Přístup s důrazem na dodržování předpisů, který spojuje tvrzení s důkazy a jasně uvádí omezení, odpovídá současným očekáváním. Hlavní zjištění: Proaktivní zveřejnění a sladění důkazů pomáhají předcházet regulatornímu riziku.

Co je to rámec s důrazem na dodržování předpisů pro AI prezentace?

Rámec, který (a) definuje tvrzení, (b) mapuje každé tvrzení na důkazy, (c) přidává lehká zveřejnění o původu dat a omezeních, (d) používá opatrný jazyk a (e) zahrnuje přílohu s důkazy pro due diligence. Hlavní zjištění: Strukturovaný, důkazy podložený rámec snižuje riziko AI-washingu a zachovává přesvědčivou sílu.

Jak mohu ukázat původ dat a riziko modelu ve slajdech?

Zahrňte dedicovaný snímek nebo přílohu s: zdroje dat, metody vzorkování, ukazatele kvality dat, verzi modelu, rozsah tréninkových dat, validační výsledky a známá rizika či režimy selhání. Nabídněte jednoduché vysvětlení, jak tato rizika snižujete v produkci. Hlavní zjištění: Původ dat a viditelnost rizik posiluje důvěryhodnost a důvěru investorů.

Jak zvládat omezení a okrajové případy v demových ukázkách?

Explicitně uznávejte omezení, popište scénáře, ve kterých AI může podávat horší výsledky, a načrtněte postupy nápravy či záložní procesy. Vyhýbejte se implikování univerzální přesnosti; představte plány pro nouzové situace a monitorovací strategie. Hlavní zjištění: Zvládání okrajových případů signalizuje zralost a řízení.

Jaké jsou osvědčené postupy pro třetí strany validaci v investičních prezentacích?

Zahrňte nezávislé výsledky testů, externí audity nebo certifikace třetích stran, pokud je to možné. Pokud externí validace není k dispozici, transparentně popište interní validační metody a velikosti vzorků a upřednostněte dlouhodobé validační plány. Hlavní zjištění: Validace třetí strany (nebo transparentní interní validace) posiluje důvěru.

Jak mohou startupy strukturovat data tak, aby si zachovaly důvěryhodnost, aniž by zbrzdily dynamiku?

Předkládejte data ve stravitelných formátech (grafy, rozmezí, souhrny) a vyhýbejte se zahlcení surovými metrikami. Používejte vyprávění k propojení výsledků validace s výsledky pro zákazníky a udržujte průběžný záznam aktualizací důkazů při dalších iteracích. Hlavní zjištění: Důvěryhodné prezentace udržují momentum tím, že vyvažují jasnost dat s jasnými, vyvíjejícími se vyprávěními o validaci.

Související témata, která byste mohli později prozkoumat pro interní prolinkování: AI governance, řízení rizik modelů, původ dat, šablony zveřejnění, shoda investor deck, regulační pokyny pro marketing AI, validace třetí stranou v AI, toky důkazů z pilotu do produkce.

Pokud chcete, mohu sledovat Reddit, Quora, LinkedIn, X a specializovaná fóra a posílat denně téma, které odkazuje na konkrétní příspěvek za posledních 24–48 hodin. Krátká poznámka k dnešnímu skenu: čerstvé diskuse o dodržování předpisů nadále tlačí týmy k tvrzením o AI založeným na důkazech, se stále větším důrazem na transparentní zveřejnění a řízené demonstrace, aby se zabránilo AI-washingu ve start-upových prezentacích. Trend je jasný: důvěryhodné, dodržující předpisy storytelling vyhrává.

Další kroky, které můžete podniknout dnes:

- Vytvořte šablonu jedné stránky listu důkazů pro další prezentaci, která bude uvádět každé tvrzení AI, zdroj důkazu, velikost vzorku, datum a omezení.

- Návrh lehkého snímku s zveřejněním, který pokrývá původ dat, verzi modelu a známá rizika, a vyhraďte si čas na konzultaci s právníkem.

- Vytvořte interní kontrolní seznam: pro každé tvrzení existuje ověřitelný zdroj? existuje upozornění pro publikum? bude publikum pravděpodobně zkoumat zdroj?

Hlavní zjištění: Praktické nástroje—mapování důkazů, zveřejnění a jednoduchý validační doplněk—promění rizika AI-washingu v sílu a posílí důvěru i jasnost vašich ukázek.