Zjistěte, jak pracovní postupy makra AI PowerPoint vyvažují rychlost a bezpečnost pomocí redakce, podepisování a auditovatelných pokynů, které dodávají vyhovující klientské prezentace.

Rychlá odpověď

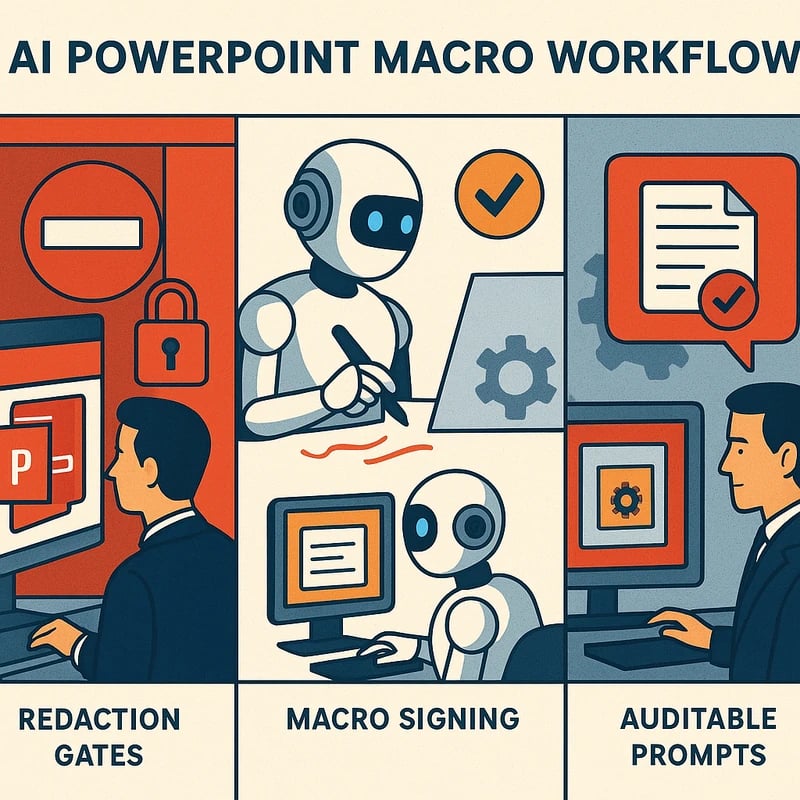

Rychlost AI PowerPoint makra může transformovat produkci klientských prezentací, ale bezpečnost a disciplína v oblasti politiky nejsou k jednání. Definitivní pracovní postup kombinuje redakci před generováním, offline nebo podnikově schválené modely, podepisování makra, vykonávání s minimálním oprávněním a auditovatelné podněty. Když jsou zavedena politická brána, použijte workflow s Copilotem, řízené správou, nebo se vraťte k on‑prem/ručním metodám na ochranu NDA a důvěrných údajů.

Hlavní zjištění: rychlost bez zajištění ochrany není škálovatelná—potřebujete auditovatelný, zásadově řízený proces pro používání AI PowerPoint makra.

Komplexní průvodce AI PowerPoint makrem

Kontext hraje roli při vytváření prezentací pro klienty. Rovnováha mezi rychlostí a bezpečností není kompromis, který byste museli akceptovat; je to problém správy s praktickými, opakovatelnými kroky. Tento průvodce nabízí podnikový workflow pro použití AI PowerPoint makra, který respektuje datové hranice, smlouvy s klienty a interní kontroly.

-

Nejprve klasifikace dat. Definujte, co lze použít při generování s využitím AI, a co musí být redigováno nebo převedeno na zástupné znaky. Proveďte posouzení citlivosti dat ještě před tím, než začnete pracovat s jakýmkoli klientským obsahem pomocí nástrojů AI. Používejte štítky (Veřejné, Vnitřní, Důvěrné, Omezené), které se mapují na vaše systémy DLP a prevence ztráty dat. Robustní workflow AI PowerPoint makra chápe obsah jako data, která vyžadují ochranu ve výchozím nastavení.

-

Lokální nebo podnikové modely. Upřednostňujte offline nebo on‑prem AI kapacity pro cokoli, co se dotýká důvěrného obsahu. Pokud musíte použít cloudové modely, směrujte pouze ne‑důvěrné podněty nebo použijte prověřený podnikový model s přísnými ujednáními o zpracování dat a sezení‑based izolací. Podnikový model by měl respektovat limity uchovávání a nemít export dat mimo vaši kontrolu. To zajišťuje, že výstupy AI PowerPoint makra zůstanou v rámci vaší korporátní hranice.

-

Podepisování makra a důvěra. Ujistěte se, že každé AI‑generované makro nebo šablona s makrovou asistencí je digitálně podepsáno důvěryhodným vydavatelem. Zaveďte politiku, která zakazuje spouštění nedůvěryhodných maker bez formálního schvalovacího postupu. Používejte certifikáty pro podepisování kódu a centralizovaný repozitář makro s verzováním a postupy odvolání.

-

Vykonávání s minimálním oprávněním. Spouštějte PowerPoint makra s minimálními potřebnými oprávněními a bez administrátorských práv na koncových zařízeních uživatelů. Omezte síťový přístup pro relace s makry a deaktivujte či sandboxujte jakékoli síťové volání, která by mohla obsah uniknout. Zaveďte whitelisting aplikací, aby pouze schválená makra mohla proběhnout v řízeném prostředí.

-

Politicky vstřícné promptání. Vytvářejte podněty tak, aby se vyhýbaly požadování či odvozování důvěrných údajů. Používejte zástupné znaky (např. [CLIENT_NAME], [CONTRACT_VALUE]), které se nahrazují jen v zabezpečeném, redigovaném prostředí. Udržujte knihovnu promptů v souladu s vaší politikou správy dat, podmínkami NDA a klientsky specifickými omezeními.

-

Redakční brány a integrace klasifikace. Před opuštěním prezentace z vašeho prostředí spusťte automatický redakční pass, který odstraní nebo maskuje citlivé identifikátory. Propojte proces redakce s vaším schématem klasifikace dat, aby výstupy jednotlivých promptů zůstaly v rámci souladu s politikou.

-

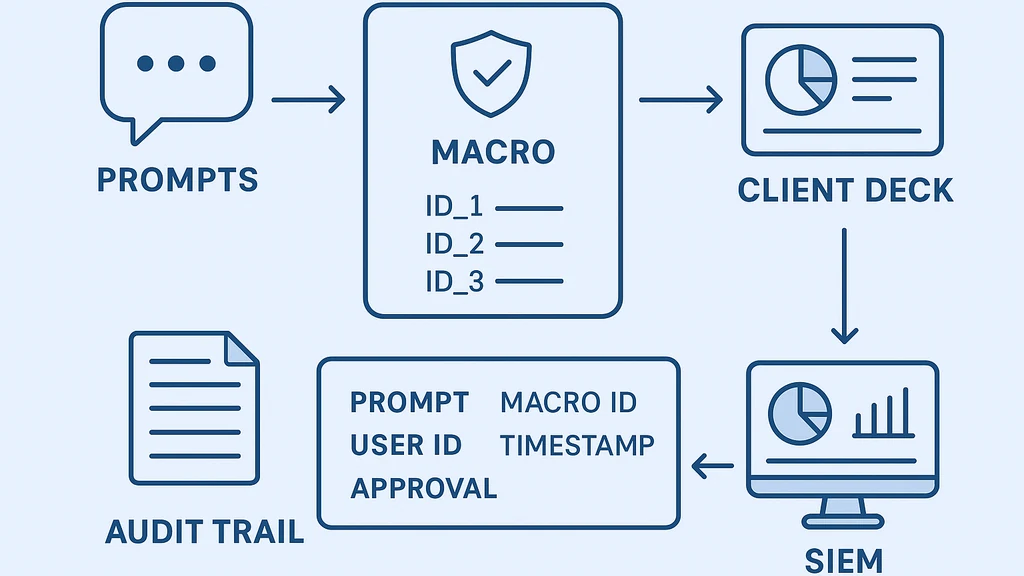

Auditovatelné promptování a výstupy. Zaznamenávejte prompt, vstupy, výstupy, identifikátory makra, identifikátory uživatelů, časové razítka a schválení do nezměnitelného auditního záznamu. Propojte tento záznam s podnikový analytics či SIEM systémem. Umožněte recenzentům snadno sledovat, jak byla prezentace vytvořena, jaká data byla použita a kdo ji schválil.

-

Verzionování a schválení. Používejte oficiální systém verzování decků s vyžadovanými schváleními pro každý AI‑asistovaný deck určený pro dodání klientovi. Sledujte změny, uložte odůvodnění AI voleb a vyžadujte podpis od odpovědného pracovníka pro správu dat nebo bezpečnost před doručením klientovi.

-

Rozhodovací stromy pro Copilot vs. on‑prem. Kdy je Copilot povolen? Kdy ne? Pokud jsou data regulovaná nebo zvlášť citlivá, vyžijte výchozí on‑prem či offline workflow. Pokud zapojení klienta umožňuje použití Copilota s omezeními politiky, povolte ho pod přísnými branami (redakce dat, prompty ověřené politikou a posuzování po vygenerování). Jasný flowchart pomáhá týmům rozhodovat se v reálném čase.

-

Praktické příklady. Prodejní inženýr použije šablonované AI PowerPoint makro k naplnění obecné prezentace redigovanými metrikami klienta, poté ji schválí revizor souladu jedním kliknutím. Konečná prezentace se uloží do omezené složky s verzí a exportním audit ►.

-

Školení a kultura. Pořádejte pravidelná školení o klasifikaci dat, technikách redakce, podepisování makra a připravenosti auditu. Používejte simulované klientské prezentace k procvičení governance workflow, aby týmy byly intuitivní s politika brán ještě před zapojením do skutečné práce na klientských projektech.

-

Související témata governance. Tento pracovní postup se překrývá s prevencí ztráty dat, klasifikací dat, dodržováním NDA, bezpečností makra a governance dodavatelského řetězce softwaru. Sladění těchto oblastí snižuje riziko při škálování používání AI PowerPoint makra napříč týmy.

Hlavní poznámka: Disciplovaný AI PowerPoint makro workflow spočívá v datové správě, volbě modelu, podepisování, nejnižších oprávněních, redakci a auditovatelných záznamech. Tyto prvky vám umožní zvýšit rychlost, aniž byste porušili NDA či smlouvy s klienty.

Proč na tom záleží

Přesvědčení, že je potřeba zrychlit práci s klientskými decky, je hmatatelné. V posledním období čelily podnikové týmy rostoucímu napětí mezi rychlostí a bezpečností, když do pracovního procesu vstoupily nástroje poháněné AI. Svolání z odvětví ukazuje dva jasné vzory:

-

Frikce politiky roste. Diskuze na Redditu mezi konzultanty zdůrazňují vyšetřování používání GenAI pro obsah klientů a následné zákazy či omezení při práci s důvěrnými decky. Praktici uvádějí potřebu rozhodovacích stromů, které jasně oddělují, kdy je Copilot nebo nástroje třetích stran povoleny, a kdy jsou povoleny on‑prem či ruční metody.

-

Roste poptávka po auditovatelné správě. LinkedIn a další profesní sítě upozorňují na vlnu podnětů nabádajících „nechte AI dělat vaše slidy“, což vyvolává obavy z úniku dat a důvěrnosti klientů. Podniky stále častěji požadují auditovatelné záznamy promptů a původ makra, aby vyhověly NDA a regulatorním očekáváním.

Dva až tři statistické údaje či průmyslové trendy, na které můžete opřít své plánování:

- Podniky stále více přijímají formální governance pro práci s klienty v AI, přijetí governance roste na vysoké desítky až nízké dvacítky procent ročně. Tento posun je poháněn předpisy na ochranu dat a omezení vyplývající z klientských smluv.

- Bezpečnostní týmy hlásí rostoucí obavy z úniku dat při použití AI k generování klientského obsahu, což vyvolává přísnější kontroly makr, redakci obsahu a politiky přístupu na základě relací.

- V prostředích, kde je AI povolena, týmy spoléhají na offline nebo lokální modely či podnikové Copiloty s přísnými politikami zpracování dat, aby se vyhnuly úniku do cloudu, často v kombinaci s robustními audit trail a postupy schvalování.

Odborné pohledy k uvažování: vedoucí představitelé zdůrazňují, že rychlost musí být doprovázena kontrolami politik; bezpečnostní lídři poukazují na nutnost klasifikací řízené redakce a podepisování makra jako základních kontrol pro jakýkoli AI workflow pro klienty.

Hlavní poznámka: Aktuální okamžik vyžaduje hybridní přístup—používat AI pro rychlost, ale každou prezentaci ukotvit v řízení, redakci a auditovatelných postupech, aby vyhověla očekáváním klientů a regulačním požadavkům.

Praktické aplikace

-

Příprava decků dopředu s šablonami připravenými na redakci. Vytvořte šablony snímků podporované AI, které se automaticky vyplní ne‑důvěrnými zástupnými hodnotami. Makro nejprve vyplní tyto zástupné hodnoty v redakované verzi, která se následně projde a bude vydána až po schválení.

-

Automatizace s důrazem na shodu. Používejte digitální podpisy u každého makra a udržujte centrální repozitář schválených makr. Implementujte automatické kontroly, které ověřují podpisy makra a omezují provedení na podepsané, důvěryhodné zdroje.

-

On‑prem/offline AI pro citlivá data. Když jsou data klienta citlivá, spusťte AI proces zcela offline. Ukládejte podněty a výstupy v izolovaném prostředí a exportujte jen po redakci a schválení.

-

Auditovatelné promptování. Udržujte knihovnu promptů s verzovanými prompty, které jsou propojeny s deckem, které vytvořily. Zajistěte, že prompty jsou dostupné jen prostřednictvím řízeného rozhraní a že veškeré používání promptů je logováno.

-

Řídící workflow rozhodovacího stromu. Zahrňte jednoduchý rozhodovací strom do onboarding materiálů: Pokud jsou data důvěrná, použijte on‑prem/offline; pokud jsou data nízké riziko, povolte podnikový Copilot s branami; vždy vyžadujte redakci, podepisování a audit logging.

-

Reálný svět: Produktový marketingový tým používá AI PowerPoint makro k načrtnutí decku s placeholdery pro data zákazníka. Redakce se provede automaticky, makro je podepsáno a compliance recenzent ověří deck před jeho sdílením se klientem. Konečná verze je uložena ve složce s omezeným přístupem a s úplnou auditní stopou.

Hlavní poznámka: Provozní zavedení používání AI PowerPoint makra se šablonami, branami governance a auditovatelnými promptami pro vytvoření škálovatelného, bezpečného automatizačního procesu.

Expertní postřehy

-

Governance‑first mindset. Odborníci v oboru tvrdí, že governance musí předcházet automatizaci. V praxi to znamená nastavit klasifikace dat, podepsaná makra a auditovatelné záznamy ještě před povolením AI‑asistované tvorby snímků pro prezentace pro klienty.

-

Redakce jako designový princip. Redakce není sekundárním krokem; je to designové omezení zabudované do makra. Podněty by měly být navrženy tak, aby se vyhýbaly vkládání citlivého obsahu, s automatickou redakcí aplikovanou v generovacím procesu.

-

Auditovatelnost jako funkce, ne vedlejší produkt. Nejsilnější workflow považují každou AI interakci za auditovatelnou událost. To zahrnuje prompty, volby modelů, ID makra a schválení.

-

Budoucí připravenost skrze politiku. Jak se podnikové AI politiky vyvíjejí, týmy by měly navrhovat workflow, která se dokáží rychle adaptovat—přepínání z cest s Copilotem na on‑prem cesty bez zásadních změn v procesech.

Hlavní poznámka: Experti doporučují governance‑first, redakci‑centered, auditovatelný přístup, který po skóř a vyženkovává s vývojem politik a podnikových potřeb.

Časté otázky

- Je bezpečné používat AI pro prezentace klientům?

- Jak mohu udržet důvěrná data v bezpečí při použití AI s PowerPointem?

- Co je Copilot v souladu s PowerPointem?

- Jak podepisovat a důvěřovat PowerPoint makrům?

- Jaká jsou rizika úniku dat z AI generovaných snímků?

- Kdy bych se měl vyhnout AI v klientských prezentacích kvůli politice?

- Jaký workflow zajistí auditovatelnost pro tvorbu AI decku?

- Jak lze implementovat redakci v AI PowerPoint makru?

- A co offline/lokální modely AI pro PowerPoint?

- Jak fungují klasifikační brány v praxi?

- Jak implementovat nejnižší oprávnění pro makra?

Hlavní poznámka: Strukturovaná FAQ pomáhá týmům rychle směřovat k přesnému politickému a technickému postupu, který potřebují.

Další kroky

- Mapujte vaše datové typy k vaší AI politice. Vytvořte matice klasifikace dat a sladte ji s vaším rámcem správy AI.

- Vytvořte redakční makro šablonovou knihovnu. Rozvíjejte šablony, které prosazují pravidla redakce, zástupné znaky a audit logging.

- Zaveďte podepisování a distribuční proces. Implementujte digitální podpisy pro makra a řízený repozitář s kontrolou přístupu a verzováním.

- Vytvořte snadný rozhodovací strom pro týmy. Dokumentujte, kdy je povolen Copilot a kdy jsou vyžadovány on‑prem/offline metody, včetně příkladů promptů a pravidel brán.

- Spusťte pilotní projekt s napříč funkcemi. Zahrňte právní, bezpečnostní, produktové a klientsky orientované týmy k otestování end‑to‑end workflow, měření rizik a dolaďování kontrol.

Hlavní poznámka: Převeďte governance na opakovatelný návod — pak škálujte, iterujte a školte.

Související témata pro interní propojení (žádné odkazy zde): AI governance, prevence ztráty dat, klasifikace dat, dodržování NDA, bezpečnost makra, governance dodavatelského řetězce software, návrh promptů, auditovatelnost, verzování, přístup s minimálními oprávněními, redakční techniky, offline AI workflow, podnikové politiky Copilot, zpracování důvěrných údajů, procesy compliance.

Lidé se ptají také

Je bezpečné používat AI pro prezentace klientů?

Ano, ale jen v rámci governance workflow. Používejte redakci, offline/on‑prem modely pro citlivá data a auditované prompty s podepisováním makra. Bezpečný přístup klade důraz na kontrolované prostředí, brány pro klasifikaci dat a auditovatelnou stopu od promptu po doručení decku. Hlavní poznámka: Bezpečnost vychází z governance, ne jen z nástrojů.

Jak mohu udržet důvěrná data v bezpečí při používání AI s PowerPointem?

Klasifikujte data, redagujte citlivé prvky a zajistěte, aby omezení makra a promptů zabránila úniku. Spouštějte AI procesy v izolovaných prostředích, udržujte výstupy v restriktivních úložištích a vyžadujte schválení před sdílením prezentací pro klienty. Hlavní poznámka: Redakce a izolace jsou základní.

Co je Copilot v souladu s PowerPointem?

Copilot v souladu s PowerPointem znamená používání Copilot‑enabled workflow, kde jsou vynucovány brány politik, data jsou chráněna a prompty jsou auditovány. Je povolen jen tehdy, když jsou splněny podnikové politiky; jinak použijte on‑prem/offline metody. Hlavní poznámka: Copilot může zrychlit relace, ale jen se slabími hranicemi.

Jak podepisovat a důvěřovat PowerPoint makrům?

Používejte digitální podpisy od důvěryhodné certifikační autority, udržujte centralizovaný, verzovaný repozitář makra a prosazujte politické vykonávání, které umožňuje spouštění jen podepsaných maker ve řízeném prostředí. Hlavní poznámka: Podepisování buduje důvěru a snižuje riziko.

Jaká jsou rizika úniku dat z AI generovaných snímků?

Rizika zahrnují neúmyslné zveřejnění důvěrných údajů prostřednictvím promptů nebo generovaného obsahu, únik tréninkových dat modelu a neoprávněný odchod dat z podniku prostřednictvím cloudových nástrojů. Zmírnění vychází z redakce, zpracování na on‑prem/offline a přísných kontrol přístupu. Hlavní poznámka: Omezující mechanismy snižují riziko úniku.

Kdy bych měl vyhnout AI v klientských deckách kvůli politice?

Pokud jsou data regulovaná, NDA‑náročná nebo by mohla ohrozit důvěrné informace klienta, přejděte na net AI nebo on‑prem procesy se všemi schváleními. Politické překážky často určují rozhodnutí spíše než technické možnosti. Hlavní poznámka: Při pochybnostech volte bezpečnost a shodu.

Jaké workflow zajistí auditovatelnost pro tvorbu AI decku?

Logujte každý prompt, ID makra a výstup; vyžadujte schválení pro každý deck; udržujte otisk, který nelze pozměnit; a centralizujte prompty, modely a podpisy makra v řízeném repozitáři. Hlavní poznámka: Auditovatelnost je páteří důvěry.

Jak lze implementovat redakci v AI PowerPoint makru?

Vložte kroky redakce do makra: detekujte citlivá pole, nahraďte je neutrálními zástupnými znaky a zajistěte, aby redigovaný obsah potvrdil recenzent dříve, než bude sdílen externě. Hlavní poznámka: Redakce by měla být automatizovaná a ověřitelná.

A co offline/lokální modely AI pro PowerPoint?

Offline/lokální modely snižují riziko expozice. Vyžadují robustní balení, zabezpečené ukládání modelů a přísnou správu kolem promptů a výstupů—ideálně integrováno s auditovatelným workflow. Hlavní poznámka: Lokální modely jsou bezpečnější výchozí volba pro citlivý klientský obsah.

Jak fungují klasifikační brány v praxi?

Klasifikační brány mapují datové typy na pravidla zpracování v rámci makro pipeline. Pokud je obsah Důvěrný nebo Omezený, makro vypíše redigovaný obsah a/nebo zablokuje sdílení až po schválení. Hlavní poznámka: Brány prosazují politiku před výstupem.

Jak implementovat nejnižší oprávnění pro makra?

Spouštějte makra s minimálním přístupem, omezte síťový přístup, uplatněte whitelist a oddělte vývojové, testovací a produkční prostředí makra, abyste minimalizovali šíření škod. Hlavní poznámka: Nejnižší oprávnění snižuje plochu útoku.

Závěrečná poznámka od Mei Lin: Na pomezí rychlosti AI a důvěry klienta by měl být váš proces tvorby decků jako kurátorská výstava — každý artefakt (data, prompt, makro) chráněn pečlivým rámem (politika, redakce, podepisování). Když týmy přijmou transparentní, auditovatelný workflow, promění se strach z AI v důvěru v výsledky. Takto vytváříte decky připravené pro klienta rychlostí myšlenek, aniž byste ohrozili bezpečnost nebo smlouvy.