Şeffaflık için pratik bir basamakla sunumlarda Yapay Zeka Açıklaması konusunda ustalaşın. Yapay zeka kullanımını nerede ve nasıl etiketleyeceğinizi öğrenin; güvenilirliği ve müşteri güvenini artırın.

Kısa Cevap

Müşteriyle yüz yüze sunumlarda yapay zeka kullanımını net ve erken bir şekilde açıklayın; izleyici, risk ve yargı konumuna uygun pratik bir “Açıklama Merdiveni” kullanın. 2026 yılında, düzenlenen bağlamlarda yapay zeka tarafından üretilen görsellerin ve verinin kökeninin açık bir şekilde etiketlenmesini bekleyin. Amaç güvenilirliği artırmak, güveni zedelemek değil—bu nedenle uygun yerlerde, altbilgilerde, eklerde veya SOW’larda yapay zeka katkılarını etiketleyin, özetleyin ve belgelendirin. Şüphede kalırsanız, şeffaflık tarafını seçin. Ana fikir: net açıklama ile güven yükselir.

Yüz yüze sunumlarda yapay zeka kullanımını açıklamanın eksiksiz rehberi (ve 2026’da ne zaman zorunlu olduğuna dair)

Sunumlarda yapay zeka açıklamasına yönelik dikkatli, adım adım bir yaklaşım, ahlaki bir aldatmaca değildir; bir yönetişim uygulamasıdır. Modern sunumlar, insan yargısı ile makine akıl yürütmesinin ortak çalışmasıdır. Açıklamalar, yapay zekanın çıktıya nasıl katkıda bulunduğunu açıklayacak kadar görünür olmalı; her slaytı yasal bir özet haline getirmek için olmayacak. Temel strateji, risk temelli bir merdivendir: neyin açıklanması gerektiği, nerede açıklanacağı ve güvenilirliği artırmak için nasıl ifade edileceği—özellikle görseller ile metin, canlı konuşmalar ile kaydedilmiş konuşmalar ve düzenlenen sektörler açısından.

- Veri noktası: Son endüstri anketlerinde, yapay zeka kullanımı şeffaf bir şekilde açıklandığında çoğu alıcı daha yüksek güven ifade ediyor; anlamlı bir azınlık ise açıklamamanın itibar riski olarak görüyor. Risk sorumluları ve yönetişim liderlerinin alıntıları, açıklamanın yorgunlukla ilgili değil, güvenilir kökenle ilgili olduğunu vurguluyor. 2025/2026 endüstri görünümü, müşteri materyallerinde yapay zeka tarafından üretilen içerik kökeni ve etiketlemesi konusundaki artan beklentileri not ediyor.

- Uzman görüşü: Önde gelen yönetişim danışmanları, açıklamanın bir güven inşa etme özelliği olduğunu, kontrol edilmesi gereken bir kutu olmadığını savunuyor. Netlik için dilbilimci bakış açısı yardımcı olur: sade dil, tutarlı terminoloji ve kim tarafından neyin doğrulandığına dair şeffaf bir anlatı.

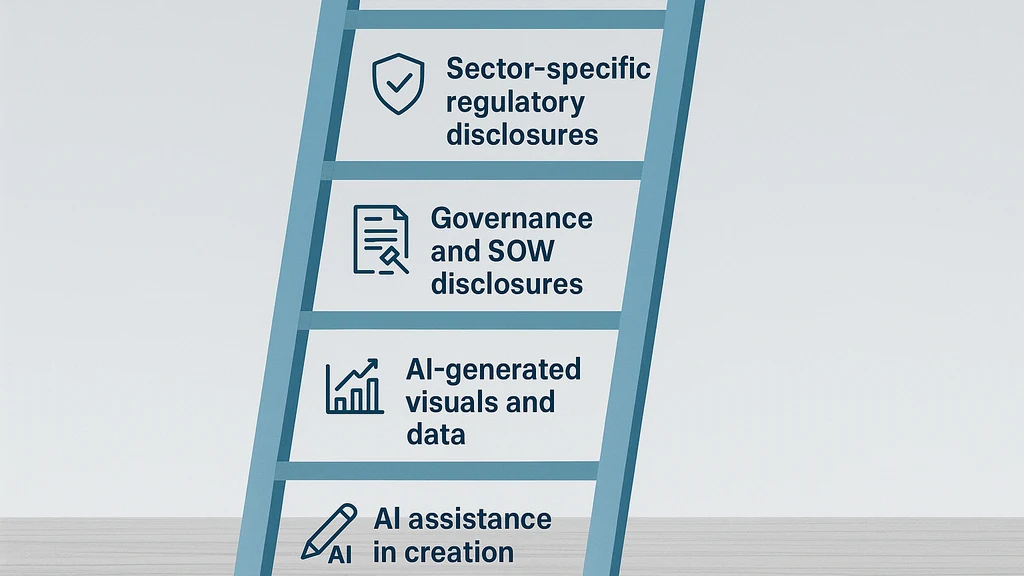

Açıklamanın neyin açıklanacağı, nerede açıklanacağı ve nasıl ifade edileceğini belirleyen temel yapı Açıklama Merdiveni’nin omurgasını oluşturur. Merdivenin dört basamağı vardır: (1) yaratımda yapay zeka yardımı açıklaması, (2) yapay zeka tarafından üretilen görseller ve verinin açıklanması, (3) SOW ve yönetişim belgelerinde açıklamalar (sözleşmesel uyum), (4) yüksek riskli veya düzenlenen bağlamlarda açıklamalar. Merdiven, açıklamanın slayt altbilgisine, ek’e veya sözleşme belgesine ait olup olmadığını karar vermenize yardımcı olur. Ayrıca tüm içerikte insan onayının gerekli olduğunu netleştirir—AI taslak oluşturabilir, ancak insanlar doğrular.

- Veri noktası: Yönetişim politikaları ve politika yapıcılar, müşteri iletişimlerinde veri kökeni ve model şeffaflığını bir risk yönetimi uygulaması olarak giderek daha çok vurguluyor. 2025 düzenleyici brifingine göre, ajanslar sair temsilatlar yapılan teklif ve sunumlarda yapay zeka katkılarını belgelemesini bekliyor.

- Uzman görüşü: Deneyimli bir halka açık konuşma koçu, iyi konumlandırılmış bir açıklamanın gergin bir itiraf değil, disiplin ve güvenilirliğin sinyali olabileceğini belirtiyor. Açıklama sanatı, şeffaf bir hikaye anlatımı gibi hissettirmeli; yasal bir feragatname gibi olmamalı.

Pratik şablonlar şu anda uyarlanabilir

- Slaytlar için görünür etiket şablonu: “AI-yardımlı içerik” veya “AI tarafından üretilen görseller (etiketler ve veri kökeni dahil).”

- Ek şablonu: “AI girdi meta verisi: üreteç, sürüm, tarih, insan doğrulama durumu.”

- SOW/katılım dili: “Teslimatlar yapay zeka yardımlı slayt bileşenlerini içerir; yapay zeka katkılı öğelerin tümü insan tarafından gözden geçirilmiş doğrulama ve uyum kontrollerinden geçer.”

- Altbilgiler ve şablonlar: AI katılımının kapsamını deckler arasında tutarlı şekilde belirten altbilgiler, AI türetilen öğelerin nasıl yorumlanacağına dair kısa bir açıklama ile.

Bugün atılabilecek temel adımlar

- Hedef kitle türü, düzenleyici maruziyet ve içerik riski temelinde basit bir karar ağacı kurun (veri yoğun veya iddia odaklı içerikler daha güçlü açıklamayı tetikler).

- AI katılımını açıkça belirten slayt altbilgileri ve ek bölüm oluşturun; meta verileri için bağlantılar ekleyin.

- Müşteri tesliminden önce AI çıktıları için hızlı bir insan doğrulama iş akışı kurun.

Pratik uygulamalar: örnek senaryolar

- Düzenlenen bir sektörde müşteri sunumu (sağlık, finans): “AI-yardımlı veriye dayalı görselleştirmeler” içeren bir slayt altbilgisi ekleyin ve veri kökeni ile model notlarını içeren ayrı bir ek oluşturun. Bir insan analisti veri kaynaklarını ve model çıktılarının uyumunu onaylar; düzenleyici beklentilerle uyumu sağlar.

- Büyük ölçekli dönüşüm için iç teklif: Görsellerdeki AI yardımı için bir SOW maddesi ekleyin; doğruluk ve önyargı kontrollerini içeren QA adımlarını özetleyen etik ve risk ekini de ekleyin.

- Kayıtlı web semineri veya sanal ana konuşma: İçerikten sonra bir açıklama slaytı ekleyin ve kapanış notlarında sözlü atıf yapın; AI tarafından üretilen bileşenler için bir kaynakça tarzında not ekleyin.

Ana çıkarım: Açıklama Merdiveni, müşteriyle yüz yüze sunumlarda yapay zeka kullanımını ne zaman ve nasıl açıklayacağınıza dair pratik, tekrarlanabilir bir çerçeve sunar; şeffaflık ile iş netliğini dengeler.

Sunumlarda AI kullanımını nasıl açıklamalısınız?

Açıklamalar net, tutarlı ve anlatı akışını bozmadan gözden kaçmayacak yerlerde konumlandırılmalıdır. Üç temel formattan birini kullanın: slayt altbilgisi, ek girişi veya SOW beyanı; risk ve izleyiciye bağlı olarak. Açıklamayı sade bir dille ifade edin: “Bu slayt AI yardımıyla hazırlandı; veri kaynakları insanlar tarafından incelendi.” Neden AI’nin kullanıldığına dair kısa bir gerekçe ekleyin (hız, veri entegrasyonu, senaryo modelleme) böylece izleyici yalnızca süreç değil, değer üzerinden anlayış sağlar.

- Veri noktası: 2025 anketlerinde, paydaşlar sonuçlarla bağlantılı net açıklamaların yetkinlik ve güven algısını önemli ölçüde artırdığını vurguladı.

- Uzman görüşü: Açıklık, karmaşıklıktan daha ağır basar; sonuçlara bağlı kısa açıklamalar (hız, doğruluk, ölçeklenebilirlik) ayrıntılı teknik açıklamalardan daha çok yankı bulur.

Ana çıkarım: Sonuçlara bağlı net, standart açıklamalar güvenilirliği güçlendirir.

AI tarafından üretilen slaytları veya görselleri ne zaman etiketlemeli?

AI, bir slaytın içeriğine, verisine veya tasarımına anlamlı şekilde katkıda bulunuyorsa etiketleyin; özellikle karar verme veya risk değerlendirmesi üzerinde etkisi varsa. AI tarafından üretilen görsellerde, AI ile üretilen görüntülerde veya AI ile sentezlenen metinlerde görsel etiketlemeler kullanın. Düzenlenen sektörlerde veya yüksek riskli iddialarda, etiketlemeyi daha belirgin yapın ve ek köken meta verisi düşünün.

- Veri noktası: düzenleyici bazı taraflar, yüksek riskli iletişimlerde AI tarafından üretilen görseller için görünür etiketlemeyi giderek daha çok bekliyor.

- Uzman alıntısı: Bir uyum yöneticisi, tutarlı etiketlemenin yazarlık ve sorumluluk konularında belirsizliği azalttığını belirtiyor.

Ana çıkarım: Riskli bağlamlarda daha güçlü etiketleme ve köken edinme güveni artırır ve belirsizliği azaltır.

Sunumlar için AI açıklama merdiveni nedir?

Merdiven dört düzeyden oluşur: (1) Oluşturmada AI yardımı (kabul et), (2) AI tarafından üretilen görseller veya veriler (etiket ve köken), (3) yönetişim ve SOW açıklamaları (sözleşmesel uyum), (4) sektör özelindeki düzenleyici açıklamalar (uyum odaklı). İçerik materyalite uygun olduğunda merdivenin hangi seviyesinde açıklama yapılması gerektiğine karar verin. İçerik, karar verme, veri bütünlüğü veya düzenleyici ilgili olup olmadığına göre değerlendirip yukarı çıkın.

- Veri noktası: resmî açıklama merdivenleri bildiren firmalar, müşteriler ve düzenleyiciler arasında daha yüksek güvene işaret ediyor.

- Uzman görüşü: Merdiven kavramı, potansiyel etki ile orantılı şeffaflığı önceliklendiren risk temelli yönetişim çerçeveleriyle uyumlu.

Ana çıkarım: AI kullanımını nerede ve nasıl açıklayacağınıza karar vermek için risk tabanlı bir merdiven kullanın.

Müşteri sunumlarında AI kullanırken güveni nasıl korursunuz?

AI’yi insan yargısının yerini almaya çalışan bir ortak pilot olarak görün; kararlar hala insan odaklı kalmalıdır. AI’nin ne katkıda bulunduğunu, insanlar tarafından neyin doğrulandığını ve kararların nerelerde insan kontrolünde olduğunu net biçimde belirtin. AI’yı şeffaf bir hikaye anlatımıyla eşleştirin: problemi anlatın, AI yaklaşımını açıklayın, doğrulama adımlarını ve insan evet/hayır anlarını paylaşın. Düzgün ve profesyonel bir üslup sürdürün; jargon yorgunluğunu önlemek için dilsel netlik ekleyin.

- Veri noktası: doğrulama adımlarını net gören ve AI’nin rolünü basitçe açıklayan izleyiciler güven sinyallerinin arttığını gösteriyor.

- Uzman görüşü: Bir dilbilimci bakışı, bağımsızlık izlenimini engellemeden tutarlı terimler seçmede yardımcı olur (AI yardımı vs. AI tarafından üretilen).

Ana çıkarım: Doğrulama konusunda şeffaflık ve açık sorumluluk, güveni korur.

Görsellerde AI etiketlemesi için regülasyon gereklilikleri var mı?

Evet, çeşitli yargı alanlarında ve giderek uluslararası müşteri çalışmaları için artan bir şekilde geçerlidir. AI tarafından üretilen görsellere etiket, AI üretimi hakkında meta verileri ve insan denetiminin beyanlarını kapsayan gereklilikler beklenmektedir. 2026’da birçok düzenlenen sektörde, sunum anında ve ilgili materyallerde açık açıklama zorunlu olacak (SOW’lar, veri sayfaları ve yönetişim belgeleri).

- Veri noktası: AB ve ABD politika gözlemcileri, 2026’da yapay zeka etiketleme normlarının sıkılaşacağını öngörüyor; finans ve sağlık gibi sektöre özgü zorunluluklar ortaya çıkabilir.

- Uzman alıntısı: Bir risk sorumlusu, yapay zeka etiketlemesi konusundaki regülasyon netliğinin yasal belirsizliği azaltacağını ve hesap verebilirliği tanımlayacağını belirtiyor.

Ana çıkarım: Görsellerde AI etiketlemesi konusunda regülasyon beklentileri güçlenecek; özellikle riskli sektörlerde daha belirgin gereklilikler olacaktır.

Slaytlar ve raporlarda AI tarafından üretilen içerik nasıl tanımlanmalı?

AI tarafından üretilen içeriği net bir dille tanımlayın: AI ne üretti, hangi veriler veya istemler kullanıldı ve hangi insan kontrolleri gerçekleştirildi. Slaytlar ve raporlarda tutarlı terminoloji kullanın ki karışıklık olmasın. Slaytlar ve raporlarda kısa bir not ve bir meta verisi ekine sahip olmak idealdir.

- Veri noktası: terminolojideki tutarlılık algılanan titizlik ve profesyonellikle ilişkilidir.

- Uzman görüşü: “AI-yardımlı” ifadesi, çoğu zaman müşterilerle “AI tarafından üretilen” ifadesinden daha iyi karşılanır, ancak tutarlılık önemlidir.

Ana çıkarım: Tutarlı, kesin dil ile meta verinin birleşimi netlik ve güven sağlar.

Web yayınları ve kaydedilmiş konuşmalarda açıklama nasıl ele alınmalı?

Canlı konuşmada açıklamayı yüksek sesle ifade edin ve AI etiketi bulunan bir slayt veya kapanış kredileri tarzı bir teşekkür notu sunun. Kayıtlar için, açıklamayı açılı dakikalarda ve kapanış kredilerinde ekleyin; köken ekine bağlantı verin. Açıklamaların erişilebilir ve arama ile bulunabilir olmasını sağlayın.

- Veri noktası: dinleyiciler, açıklamaları hem konuşma hem yazılı işaretlerle bir arada gördüklerinde hatırlama olasılıkları artar.

- Uzman görüşü: Çift kanallı açıklama (konuşulan + yazılı) hesap verebilirliği güçlendirir.

Ana çıkarım: Canlı ve kaydedilmiş formatlarda, dil destekli olan çift-kanallı açıklama güveni güçlendirir.

Düzenlenen sektörler için açıklama nasıl uyarlanır?

Düzenlenen sektörler, açıklama, köken ve doğrulama konusunda daha yüksek standartlar talep eder. Örneğin sağlık ve finans alanlarında, veri kaynaklarını, model doğrulama adımlarını ve insan denetimini lisanslama veya yönetişim belgelerinde açıkça belgelemeniz gerekebilir. Pazarlama veya teknoloji alanında açıklama daha az zorlu olabilir ancak yine de şeffaflık ve risk yönetimi için elzemdir.

- Veri noktası: sektöre özgü açıklama yönergeleri giderek “açık AI kökeni” ilkesine uyum sağlamak üzere uyumlaştırılıyor.

- Uzman alıntısı: Bir uyum stratejisti, “her sektör için tek tip açıklama” yaklaşımının düzenlenen ortamlarda işe yaramadığını, sektöre özgü risklere göre uyarlamanın en iyi uygulama olduğunu belirtiyor.

Ana çıkarım: Düzenlenen sektörler için daha açık, yapılandırılmış ve doğrulanabilir köken gösterimi gereklidir.

İçerik açıklaması için güçlü yönetişim adımları nelerdir?

Hafif ama hesap verebilir bir iş akışı uygulayın: taslak, doğrulama, etiketleme, onay ve arşivleme; sürüm kontrolüyle. Açıklamalar için standart bir metadata şablonu kullanın ve açıklamalardan kimin sorumlu olduğunu netleştirin.

- Veri noktası: yönetişim çerçeveleri son dakika değişikliklerini ve yanlış etiketlemeyi azaltır.

- Uzman görüşü: Hesap verebilirlik, güvenilir AI açıklamalarının omurgasıdır.

Ana çıkarım: Net bir yönetişim iş akışı, açıklamayı güvenilir ve ölçeklenebilir kılar.

Ekipleri AI açıklama politikalarına uyması için nasıl eğitebilirsiniz?

Hızlı başvuru kartları, canlı inceleme tatbikatları ve yapay zeka katkılarıyla ilgili müşteri sorularını simüle eden senaryo tabanlı alıştırmalar içeren pratik eğitimler yürütün. Politikalar geliştikçe eğitimi düzenli olarak güncelleyin.

- Veri noktası: sürekli eğitim güven ve sunum kalitesini arttırır.

- Uzman görüşü: Gerçek dünya senaryoları üzerinde pratik yapmak baskı altındaki tereddütü azaltır.

Ana çıkarım: Sürekli, senaryo tabanlı eğitim politika uyumunu sürdürür.

Açıklama Merdiveni’ni benimseyen organizasyonlar için sonraki adımlar

- Bir açıklama sahibi atayın ve izleyici, risk ve sektör için açıklama seviyesini eşleyen tek sayfalık bir politika oluşturun.

- AI köken alanları ve standart slayt altbilgisi dilini içeren yeniden kullanılabilir bir ek şablonu geliştirin.

- Normlar geliştikçe dil ve meta verileri güncellemek için ekiplerle üç aylık bir “AI açıklamaları incelemesi” yapın.

Anahtar çıkarım: Küçükten başlayın, hızlı ölçeklendirin ve açıklama uygulamalarınızı sürekli iyileştirin.

Profesör Harold Jenkins’ten son not

Dil, mizah gibi, aydınlatmalı olmalı, karanlıklaştırıcı olmamalı. Yapay zeka açıklaması konuşması, teknik bir konu kadar dilbilimsel ve etik bir konuşmadır. Netlik ile hesap verebilirliği birleştirdiğinizde, AI deck’inizin kenarında saklanan bir gölge değil, güvenilirliğinizi yükselten şeffaf bir yol arkadaşı haline gelir. İyi uygulanmış bir Açıklama Merdiveni, en iyi anlamda bir performans ipucudur: güven, merak ve işbirliğini davet eder, şüpheyi değil.

İç bağlantılar için ilgili konular (kavramsal özet)

- Müşteri çalışmalarında AI için şeffaflık politikası

- İş sunumları için veri kökeni ve model hesap verebilirliği

- Kamu konuşmalarında ve müşteri iletişimlerinde AI’nin etik kullanımı

- AI destekli içeriklerde ESG ve yönetişim dikkate alınması

- Pazarlama ve teklifler için AI etiketleme regülasyon beklentileri

- AI tarafından üretilen içerikler için metadata standartları

Ana çıkarım: Konu, yönetişim, etik, düzenleme ve iletişim stratejileri ile kesişir—bunlar, iç bağlantılar ve fonksiyonlar arası işbirliği için verimli zeminlerdir.

İstersen bunu daha da belirli bir sektöre (sağlık hizmetleri, finansal hizmetler, teknoloji veya hükümet) göre özelleştirebilirim ya da bir sonraki yönetim kuruluna sunabileceğiniz tek sayfalık, müşteriyle kavrayıcı “AI Açıklama Merdiveni” hızlı referans sayfası hazırlayarak sunumunuza katmanıza yardımcı olabilirim.