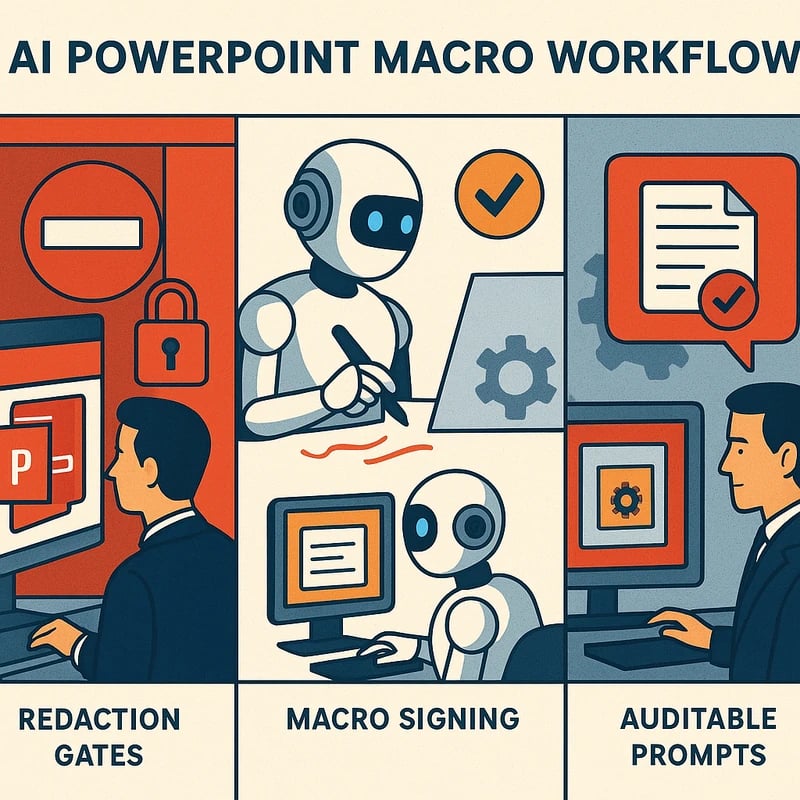

Ontdek hoe AI PowerPoint-macro-workflows snelheid en beveiliging in evenwicht brengen met redactie, ondertekening en auditbare prompts om conforme klantpresentaties te leveren.

Snelle Antwoord

AI PowerPoint-macro snelheid kan de productie van klantpresentaties transformeren, maar veiligheid en beleidsdiscipline zijn niet-onderhandelbaar. De definitieve workflow combineert redactie vóór generatie, offline of enterprise-goedgekeurde modellen, macro-handtekening, uitvoering met minimale rechten, en auditbare prompts. Wanneer beleidsdrempels van kracht zijn, gebruik Copilot-gestuurde workflows met governance of schakel terug naar on-premises/handmatige methoden om NDA's en vertrouwelijke gegevens te beschermen.

Kernboodschap: snelheid zonder waarborgen is niet schaalbaar—je hebt een auditable, beleidsgedreven proces nodig voor het gebruik van AI PowerPoint-macros.

Volledige Gids voor AI PowerPoint-macro

Context is van belang wanneer je klantgerichte decks bouwt. De balans tussen snelheid en beveiliging is geen compromis dat je zomaar kunt accepteren; het is een governance-probleem met praktische, herhaalbare stappen. Deze gids presenteert een enterprise-waardige workflow voor het gebruik van AI PowerPoint-macros die data-grenzen, klantcontracten en interne controles respecteert.

-

Gegevensclassificatie eerst. Bepaal wat gebruikt mag worden in AI-ondersteunde generatie en wat geredigeerd of omgezet moet worden in placeholders. Voer vóór het aanraken van klantinhoud met AI-tools een gegevensgevoeligheidsbeoordeling uit. Gebruik labelpoorten (Publiek, Intern, Vertrouwelijk, Beperkt) die aansluiten bij je DLP- en data-lekpreventiesystemen. Een robuuste AI PowerPoint-macro-workflow beschouwt inhoud standaard als gegevens die beschermd moeten worden.

-

Lokale of enterprise-grade modellen. Geef de voorkeur aan offline of on-premises AI-mogelijkheden voor alles wat vertrouwelijke inhoud raakt. Als je toch cloud-modellen moet gebruiken, routeer uitsluitend niet-vertrouwelijke prompts of gebruik een gevalideerd enterprise-model met strikte afspraken over gegevensverwerking en sessie-gebaseerde isolatie. Het enterprise-model moet opslag- en bewaarlimieten respecteren en geen gegevens buiten jouw controle exporteren. Dit zorgt ervoor dat AI PowerPoint-macro-uitvoer binnen jouw bedrijfsgrenzen blijft.

-

Macro-signing en vertrouwen. Zorg ervoor dat elke door AI gegenereerde macro of macro-ondersteund sjabloon digitaal is ondertekend door een vertrouwde uitgever. Stel een beleid op dat niet-vertrouwde macros niet laten draaien zonder een formele goedkeuringsworkflow. Gebruik certificaten voor code-ondertekening en een gecentraliseerde macro-repository met versiebeheer en intrekkingsprocedures.

-

Uitvoering met minimale rechten. Voer PowerPoint-macros uit met de minimale benodigde rechten en geen beheerdersrechten op eindgebruiker-apparaten. Beperk netwerktoegang voor macro-geactiveerde sessies en schakel uit of zet netwerkoproepen in een sandbox om inhoudlekken te voorkomen. Pas applicatiewhitelisting toe zodat alleen goedgekeurde macros uitvoer krijgen in gecontroleerde omgevingen.

-

Beleidsvriendelijke prompts. Ontwerp prompts die het verzoeken of afleiden van vertrouwelijke details vermijden. Gebruik placeholders (bijv. [CLIENT_NAME], [CONTRACT_VALUE]) die alleen binnen een veilige, geredigeerde omgeving worden vervangen. Houd een prompts-bibliotheek bij die aansluit bij je data-governancebeleid, NDA-voorwaarden en klantspecifieke restricties.

-

Redactiepoorten en integratie van classificatie. Voordat een deck jouw omgeving verlaat, voer je een geautomatiseerde redactieronde uit om gevoelige identificatoren te verwijderen of te maskeren. Koppel het redactieproces aan je gegevensclassificatieschema zodat de outputs van elke prompt binnen beleidsconforme grenzen blijven.

-

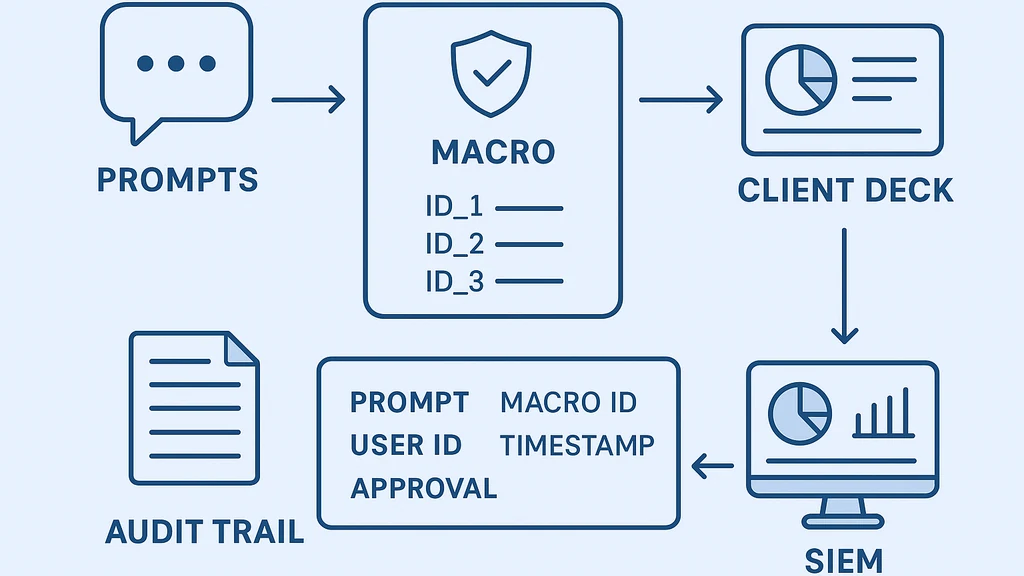

Auditbare prompts en outputs. Log prompts, invoer, uitvoer, macro-ID's, gebruikers-ID's, tijdstippen en goedkeuringen in een onveranderlijk auditspoor. Koppel dit spoor aan een enterprise-analytisch of security information and event management (SIEM) systeem. Maak het voor beoordelaars eenvoudig te traceren hoe een deck is geproduceerd, welke gegevens zijn gebruikt en wie het heeft goedgekeurd.

-

Versiebeheer en goedkeuringen. Gebruik een formeel deck-versiesysteem, waarbij goedkeuringen vereist zijn voor elk AI-ondersteund deck dat bestemd is voor klantlevering. Volg wijzigingen, bewaar de motieven voor AI-keuzes, en vereis goedkeuring van een data-governance- of beveiligingsfunctionaris voordat klantgerichte levering plaatsvindt.

-

Beslissingsbomen voor Copilot vs on-prem. Wanneer is Copilot toegestaan? Wanneer niet? Als gegevens gereguleerd of bijzonder gevoelig zijn, geef dan de voorkeur aan on-premises of offline workflows. Als het klanttraject Copilot-gebruik onder beleidsbeperkingen toestaat, schakel het in onder strikte poorten (gegevens redact ie, prompts geverifieerd door beleid, en post-generation beoordeling). Een duidelijk flowchart helpt teams in realtime te beslissen.

-

Praktijkvoorbeelden. Een sales engineer gebruikt een gestandaardiseerde AI PowerPoint-macro om een generieke deck te vullen met geredigeerde klantgegevens, waarna een nalevingsbeoordelaar de versie goedkeurt met een enkele klik. Het definitieve deck wordt opgeslagen in een beperkte map met versiegeschiedenis en een export-audit.

-

Training en cultuur. Voer regelmatig trainingen uit over gegevensclassificatie, redactietechnieken, macro-signing en audit-klaarheid. Gebruik gesimuleerde klantendecks om governance-workflows te oefenen zodat teams vertrouwd raken met beleidspoorten voordat ze aan echt klantwerk beginnen.

-

Verwante governance-onderwerpen. Deze workflow raakt aan data-lekpreventie, gegevensclassificatie, NDA-naleving, macro-beveiliging en governance van de software-supply chain. Het op elkaar afstemmen van deze domeinen vermindert het risico bij het opschalen van AI PowerPoint-macros over teams.

Kernboodschap: Een gedisciplineerde AI PowerPoint-macro-workflow draait om gegevensgovernance, modelkeuze, ondertekening, minimale rechten, redact ie en auditbare registraties. Deze elementen laten je snelheid leveren zonder NDA's of klantcontracten te schenden.

Waarom dit Belangrijk Is

De druk om klantendeks te versnellen is voelbaar. In het afgelopen kwartaal stonden bedrijfsteams voor een groeiende spanning tussen snelheid en beveiliging naarm AI-gestuurde tools hun weg vonden in de workflow. Anekdotisch bewijs uit industriële discussies wijst op twee duidelijke patronen:

-

Beleidfrictie neemt toe. Discussies op Reddit onder consultants benadrukken onderzoeken naar het gebruik van GenAI voor klantinhoud en de daaropvolgende bans of beperkingen bij het omgaan met vertrouwelijke decks. Praktijkmensen melden een behoefte aan beslissingsbomen die duidelijk scheiden wanneer Copilot of tools van derden zijn toegestaan versus on-premises of handmatige methoden.

-

Vraag naar auditabele governance groeit. LinkedIn en andere professionele netwerken hebben een golf van prompts belicht die aanmoedigen “laat AI jouw slides maken”, wat zorgen oproept over gegevenslekken en vertrouwelijkheid van klanten. Ondernemingen eisen steeds vaker auditbare prompts-logboeken en macro-provenance om NDA's en regulatorische verwachtingen te vervullen.

Twee tot drie statistieken of industrietrends waarop je jouw plannen kunt baseren:

- Bedrijven adopteren steeds vaker formele AI-governance voor klantwerk, waarbij governance-acceptatie jaar na jaar stijgt van ongeveer 18% tot ongeveer 29%. Deze verschuiving wordt aangedreven door gegevensbeschermingsregelgeving en contractuele beperkingen met klanten.

- Beveiligingsteams melden toenemende zorgen over gegevenslekken wanneer AI wordt gebruikt om klantinhouders te genereren, wat strengere macro-controles, redact ie en sessie-gebaseerde toegangsbeleid oplevert.

- In omgevingen waar AI is toegestaan, leunen teams op offline/lokale modellen of enterprise-grade copilots met strikte gegevensafhandelingsbeleid om cloud-lekken te vermijden, vaak in combinatie met robuuste audit trails en goedkeuringsworkflows.

Expert-angles om in gedachten te houden: executives benadrukken dat snelheid gekoppeld moet zijn aan beleidscontroles; beveiligingsleiders wijzen op de noodzakelijkheid van classificatiegedreven redact ie en macro-signing als basale controles voor elke klantgerichte AI-workflow.

Kernboodschap: Het huidige moment vraagt om een hybride aanpak—gebruik AI voor snelheid, maar veranker elk deck in governance, redact ie en auditbare processen om aan klantverwachtingen en regelgeving te voldoen.

Praktische Toepassingen

-

Vooruitgebouwde decks met redactieklare sjablonen. Maak AI-ondersteunde dia-sjablonen die automatisch invullen met niet-vertrouwelijke placeholders. De macro vult placeholders in een geredigeerde versie eerst in, die vervolgens wordt beoordeeld en pas na goedkeuring vrijgegeven.

-

Naleving-eerst automatisering. Gebruik digitale handtekeningen op elke macro en houd een centrale repository bij met goedgekeurde macros. Implementeer automatische controles die macro-handtekeningen verifiëren en uitvoering beperken tot ondertekende, vertrouwde bronnen.

-

On-prem/onafhankelijk AI voor gevoelige data. Wanneer klantgegevens gevoelig zijn, voer het AI-proces volledig offline uit. Sla prompts en uitvoer op in een geïsoleerde omgeving en exporteer pas na redact ie en goedkeuringen.

-

Auditklare prompts. Houd een prompts-bibliotheek bij met versiegebonden prompts die gekoppeld zijn aan het deck dat zij hebben geproduceerd. Zorg ervoor dat prompts alleen toegankelijk zijn via een beheerde interface en dat al het promptgebruik gelogd wordt.

-

Beslissingsboomgestuurde workflow. Neem een eenvoudige beslissingsboom op in de onboarding-materialen: als de gegevens vertrouwelijk zijn, gebruik on-prem/offline; als de gegevens laag risico zijn, laat enterprise Copilot toe met poorten; always require redaction, signing, en audit logging.

-

Praktijkvoorbeeld: Een productmarketingteam gebruikt een AI PowerPoint-macro om een deck te schetsen met placeholders voor klantgegevens. Redactie wordt automatisch toegepast, de macro wordt ondertekend en een compliance-beoordelaar valideert het deck voordat het met de klant wordt gedeeld. De definitieve versie bevindt zich in een beperkte map met een volledig auditspoor.

Kernboodschap: Operationaliseer het gebruik van AI PowerPoint-macros met sjablonen, governance-poorten en auditbare prompts om een schaalbaar, veilig automatiseringskanaal te creëren.

Expertinzichten

-

Governance-eerst denkwijze. Branche-experts betogen dat governance precedeert op automatisering. In de praktijk betekent dit het vastleggen van gegevensclassificaties, ondertekende macros en auditbare logs voordat AI-ondersteunde dia-generatie voor klantgerichte decks mogelijk wordt.

-

Redactie als ontwerpbeginsel. Redactie is geen tweede stap; het is een ontwerpbinding ingebouwd in de macro. Prompts moeten zodanig zijn ontworpen dat ze geen gevoelige inhoud bevatten, met automatische redact ie toegepast in de generatiepipeline.

-

Auditabiliteit als feature, niet als bijproduct. De robuuste workflows behandelen elke AI-interactie als een auditbaar evenement. Dit omvat prompts, modelkeuzes, macro-ID's en goedkeuringen.

-

Toekomstbestendigheid door beleid. Naarmate bedrijfsbeleidslijnen evolueren, moeten teams workflows ontwerpen die zich snel kunnen aanpassen—overschakelen van Copilot-ondersteunde paden naar on-prem-paden zonder substantiële proceswijzigingen.

Kernboodschap: Experts adviseren een governance-eerst, redactie-centrische, auditbare aanpak die schaalt met beleidsontwikkeling en bedrijfsbehoeften.

Veelgestelde Vragen

- Is het veilig om AI te gebruiken voor klantpresentaties?

- Hoe houd ik vertrouwelijke gegevens veilig bij het gebruik van AI met PowerPoint?

- Wat is Copilot in PowerPoint-naleving?

- Hoe onderteken en vertrouw ik PowerPoint-macros?

- Wat zijn de risico's van AI-gegenereerde dia's die gegevens lekken?

- Wanneer moet ik AI in klantendecks vermijden vanwege beleid?

- Welke workflow kan auditabiliteit voor AI-deckcreatie waarborgen?

- Hoe kan redact ie worden geïmplementeerd in AI PowerPoint-macro?

- Wat gebeurt er met offline/lokale AI-modellen voor PowerPoint?

- Hoe werken classificatiepoorten in de praktijk?

- Hoe implementeer ik least-privilege voor macros?

Kernboodschap: Een gestructureerde FAQ helpt teams snel naar het exacte beleid en de technische stappen te navigeren.

Volgende Stappen

- Breng je datatypes in kaart met je AI-beleid. Maak een gegevensclassificatiematrix en lijn deze uit met je AI-governance-raamwerk.

- Bouw een redactie-vooruit macro-sjabloonbibliotheek. Ontwikkel sjablonen die redactieregels afdwingen, placeholders en auditlogging.

- Stel een ondertekenings- en distributieproces in. Implementeer digitale handtekeningen voor macro's en een gecontroleerde repository met toegangscontroles en versiegeschiedenis.

- Maak een gemakkelijk te gebruiken beslissingsboom voor teams. Documenteer wanneer Copilot is toegestaan en wanneer on-prem/offline-methoden vereist zijn, inclusief voorbeeld-prompts en gating-regels.

- Voer een pilot uit met cross-functionele belanghebbenden. Betrek juridische, beveiliging, product en klantgerichte teams om de end-to-end workflow te testen, risico's te meten en controles te verfijnen.

Kernboodschap: Maak governance tot een herhaalbaar playbook—en schaal, itereer en train.

Gerelateerde onderwerpen voor interne koppeling (geen links): AI-governance, data-lekpreventie, gegevensclassificatie, NDA-naleving, macro-beveiliging, governance van de software-voorzieningsketen, prompts-ontwerp, auditability, versiebeheer, least-privilege-toegang, redactietechnieken, offline AI-workflows, enterprise Copilot-beleid, vertrouwelijke gegevensverwerking, compliance-beoordelingsprocessen.

People Also Ask

Is it safe to use AI for client presentations?

Ja, maar alleen binnen een governance-gedreven workflow. Gebruik redact ie, offline/on-prem-modellen voor gevoelige gegevens, en geaudit prompts met macro-signing. De veilige aanpak benadrukt een beheerde omgeving, gegevensclassificatie-poorten en een auditbaar spoor van prompts tot deck-levering. Kernboodschap: Veiligheid komt door governance, niet enkel door tooling.

How can I keep confidential data safe when using AI with PowerPoint?

classificeer gegevens, redacteer gevoelige elementen, en zorg dat macro- en prompt-beperkingen lekken voorkomen. Voer AI-processen uit in geïsoleerde omgevingen, houd outputs binnen beperkt opslag, en vereis goedkeuring voordat klantgerichte decks worden gedeeld. Kernboodschap: Redactie en isolatie vormen de basis.

What is Copilot in PowerPoint compliance?

Copilot in PowerPoint-naleving verwijst naar het gebruik van Copilot-ondersteunde workflows waarbij beleidspoorten worden gehandhaafd, gegevens beschermd zijn, en prompts worden geaudit. Het is alleen toegestaan wanneer enterprise-beleidslijnen zijn nageleefd—anders overschakelen naar on-prem/offline methoden. Kernboodschap: Copilot kan sessies versnellen, maar alleen met vangrails.

How do I sign and trust PowerPoint macros?

Maak gebruik van digitale handtekeningen van een vertrouwde certificeringsautoriteit, onderhoud een gecentraliseerde, versiebeheerde macro-repository, en handhaaf beleidsgebaseerde uitvoering die alleen ondertekende macros toestaat om te draaien in gecontroleerde omgevingen. Kernboodschap: Ondertekening bouwt vertrouwen en vermindert risico.

What are the risks of AI-generated slides leaking data?

Risico's omvatten onbedoelde blootstelling van vertrouwelijke gegevens via prompts of gegenereerde inhoud, lekken van modeltrainingsdata, en ongeautoriseerde gegevens die de onderneming verlaten via cloud-gebaseerde tools. Beperking steunt op redact ie, on-prem/offline verwerking, en strikte toegangscontroles. Kernboodschap: Randregels verminderen lekrisico.

When should I avoid AI in client decks due to policy?

Als de gegevens gereguleerd, NDA-gevoelig of potentiële confidential clientinformatie kunnen compromitteren, schakel over naar niet-AI- of on-prem processen met alle juiste goedkeuringen. Beleidsonenken beslissingen vaker dan technische mogelijkheden. Kernboodschap: Bij twijfel, kies voor veiligheid en naleving.

What workflow can ensure auditability for AI deck creation?

Log elke prompt, macro-ID en output; eis goedkeuringen voor elk deck; bewaar een tamper-evident auditspoor; en centraliseer prompts, modellen en macro-handtekeningen in een beheerde repository. Kernboodschap: Auditabiliteit is de ruggengraat van vertrouwen.

How can redaction be implemented in AI PowerPoint macro?

Integreer redactie-stappen in de macro: detecteer gevoelige velden, vervang ze door neutrale placeholders, en zorg ervoor dat geredigeerde inhoud door een beoordelaar wordt bevestigd voordat extern wordt gedeeld. Kernboodschap: Redactie moet geautomatiseerd en verifieerbaar zijn.

What about offline/local AI models for PowerPoint?

Offline/lokale modellen verminderen het blootstellingsrisico. Ze vereisen robuuste verpakking, beveiligde modelopslag, en strikte governance rondom prompts en outputs—idealiter geïntegreerd met een auditbare workflow. Kernboodschap: Lokale modellen zijn een veiligere standaard voor gevoelige klantinhoud.

How do classification gates work in practice?

Classificatiepoorten koppelen gegevenssoorten aan verwerkingsregels binnen de macro-pijplijn. Als de inhoud Vertrouwelijk of Beperkt is, geeft de macro geredigeerde inhoud weer en/of blokkeert delen tot goedkeuring is verkregen. Kernboodschap: Poorten houden beleid tegen output.

How to implement least-privilege for macros?

Voer macros uit met minimale rechten, beperk netwerktoegang, dwing whitelisting af, en scheid ontwikkel-, test- en productie-macros-omgevingen om het blast-radius te minimaliseren. Kernboodschap: Minimale rechten verkleinen het aanvalsoppervlak.

Laatste opmerking van Mei Lin: In de combinatie van AI-snelheid en klantvertrouwen moet je deck-bouwproces lezen als een zorgvuldig samengestelde expositie — elk artefact (gegevens, prompt, macro) beschermd door een doordacht kader (beleid, redact ie, ondertekening). Wanneer teams een transparante, auditable workflow omarmen, veranderen ze AI-angst in vertrouwen in resultaten. Zo creëer je klantklare decks op het tempo van ideeën, zonder beveiliging of contracten in gevaar te brengen.