Erfahren Sie, wie KI PowerPoint-Makro-Workflows Geschwindigkeit und Sicherheit durch Redaktion, Signaturen und auditierbare Aufforderungen ausbalancieren, um konforme Kunden-Decks bereitzustellen.

Kurze Antwort

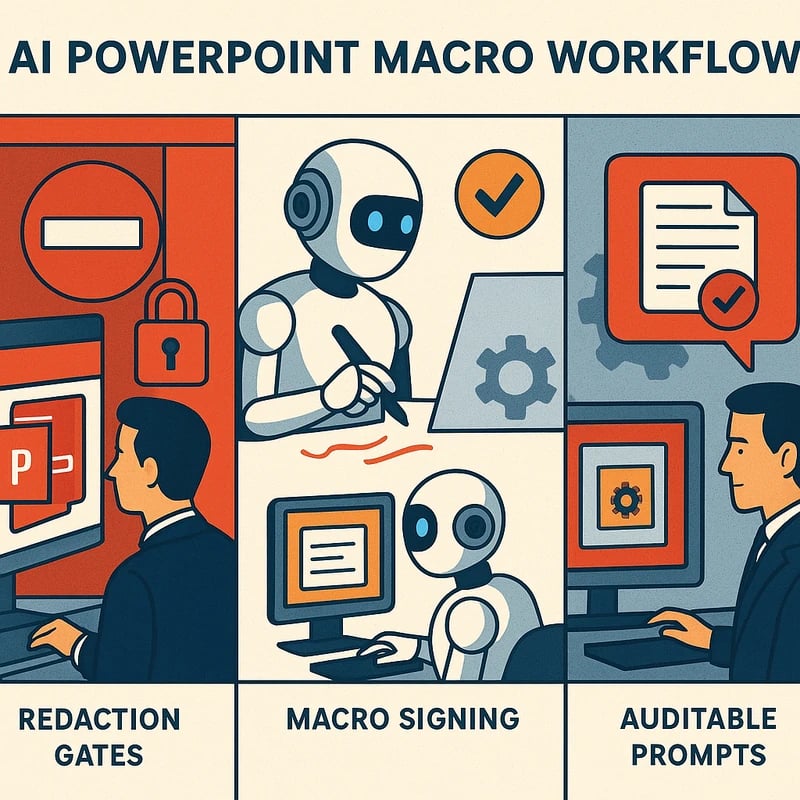

Die Geschwindigkeit von KI-PowerPoint-Makro kann die Produktion von Kundenpräsentationen erheblich verändern, doch Sicherheit und Richtliniendisziplin sind nicht verhandelbar. Der endgültige Arbeitsablauf kombiniert Redaktion vor der Generierung, Offline- oder unternehmensgenehmigte Modelle, Makro-Signierung, Ausführung mit Minimalrechten und auditierbare Eingaben. Wenn Richtlinienschranken vorhanden sind, verwenden Sie Copilot-fähige Arbeitsabläufe mit Governance oder greifen Sie auf On-Prem/Manuell-Methoden zurück, um NDAs und vertrauliche Daten zu schützen.

Wesentliche Erkenntnis: Geschwindigkeit ohne Sicherheitsvorkehrungen ist nicht skalierbar – Sie benötigen einen auditierbaren, richtliniengesteuerten Prozess für die Verwendung von KI-PowerPoint-Makros.

Kompletter Leitfaden zu KI-PowerPoint-Makros

Kontext ist entscheidend, wenn Sie klientenorientierte Folien erstellen. Das Gleichgewicht zwischen Geschwindigkeit und Sicherheit ist kein Trade-off, das man einfach so akzeptiert; es ist ein Governance-Problem mit praktischen, wiederholbaren Schritten. Dieser Leitfaden skizziert einen unternehmensbereiten Workflow für die Nutzung von KI-PowerPoint-Makros, der Datenabgrenzungen, Kundenverträge und interne Kontrollen respektiert.

-

Datenklassifizierung zuerst. Definieren Sie, was in der KI-gestützten Generierung verwendet werden kann und was redigiert oder in Platzhalter umgewandelt werden muss. Führen Sie vor dem Zugriff auf Kundendaten mit KI-Tools eine Datenempfindlichkeitsbewertung durch. Verwenden Sie Label-Gates (Öffentlich, Intern, Vertraulich, Beschränkt), die auf Ihre DLP- und Data-Loss-Prevention-Systeme abbilden. Ein robuster KI-PowerPoint-Makro-Workflow behandelt Inhalte standardmäßig als Daten, die geschützt werden müssen.

-

Lokale oder unternehmensgerechte Modelle. Bevorzugen Sie Offline- oder On-Premises-KI-Fähigkeiten für alles, was vertrauliche Inhalte betrifft. Wenn Sie Cloud-Modelle verwenden müssen, leiten Sie nur nicht vertrauliche Aufforderungen weiter oder setzen Sie ein geprüftes Enterprise-Modell mit strengen Datenverarbeitungsvereinbarungen und sitzungsbasierter Isolation ein. Das Enterprise-Modell sollte Aufbewahrungsgrenzen respektieren und keinen Datenaus export außerhalb Ihrer Kontrolle ermöglichen. Dies stellt sicher, dass KI-PowerPoint-Makro-Ausgaben innerhalb Ihrer Unternehmensgrenze bleiben.

-

Makro-Signierung und Vertrauen. Stellen Sie sicher, dass jedes KI-generierte Makro oder makro-unterstützte Vorlage digital von einem vertrauenswürdigen Verleger signiert wird. Etablieren Sie eine Richtlinie, die untrusted Makros vom Ausführen ohne formalen Genehmigungs-Workflow ausschließt. Verwenden Sie Code-Signier-Zertifikate und ein zentrales Makro-Repository mit Versionskontrolle und Widerrufsverfahren.

-

Ausführung mit Minimalrechten. Führen Sie PowerPoint-Makros mit den geringstmöglichen Rechten aus und ohne Administratorrechte auf Endbenutzergeräten. Beschränken Sie den Netzwerkzugriff für makro-aktivierte Sitzungen und deaktivieren oder sandboxen Sie Netzaufrufe, die Inhalte preisgeben könnten. Wenden Sie Anwendungs-Whitelisting an, sodass nur genehmigte Makros in kontrollierten Umgebungen ausgeführt werden.

-

Richtlinienfreundliche Eingaben. Formulieren Sie Eingabeaufforderungen so, dass keine vertraulichen Details abgefragt oder abgeleitet werden. Verwenden Sie Platzhalter (z. B. [CLIENT_NAME], [CONTRACT_VALUE]), die nur in einer sicheren, redigierten Umgebung ersetzt werden. Pflegen Sie eine Prompt-Bibliothek, die mit Ihrer Daten-Governance-Richtlinie, NDA-Bedingungen und klientenspezifischen Einschränkungen übereinstimmt.

-

Redaktions-Gates und Integration der Klassifikation. Bevor ein Deck Ihre Umgebung verlässt, führen Sie eine automatische Redaktionsprüfung durch, um sensible Kennungen zu entfernen oder zu maskieren. Verknüpfen Sie den Redaktionsprozess mit Ihrem Datenklassifikationsschema, sodass jede Prompt-Ausgabe innerhalb der Richtliniengrenzen verbleibt.

-

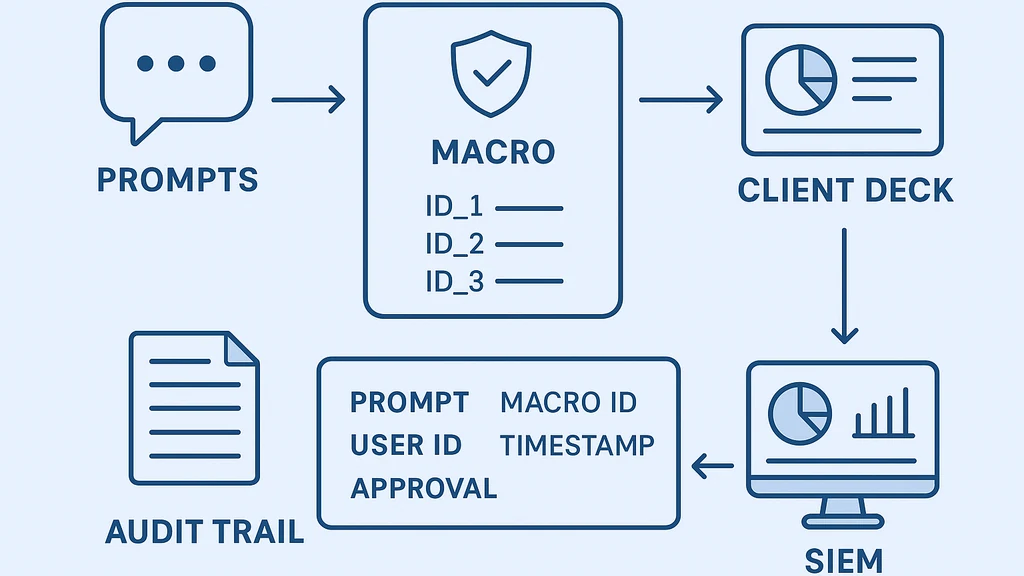

Auditierbare Eingaben und Ausgaben. Protokollieren Sie Prompts, Eingaben, Ausgaben, Makro-IDs, Benutzer-IDs, Zeitstempel und Genehmigungen in einer unveränderlichen Audit-Spur. Verknüpfen Sie diese Spur mit einem Enterprise-Analytics- oder SIEM-System. Machen Sie es Reviewern leicht, nachzuverfolgen, wie ein Deck produziert wurde, welche Daten verwendet wurden und wer es genehmigt hat.

-

Versionskontrolle und Genehmigungen. Verwenden Sie ein formelles Deck-Versionierungssystem, bei dem für jedes AI-unterstützte Deck, das an den Kunden geliefert werden soll, Genehmigungen erforderlich sind. Verfolgen Sie Änderungen, speichern Sie die Begründung für KI-Entscheidungen und verlangen Sie eine Unterschrift von einem Datenschutz- oder Sicherheitsbeauftragten vor der kundenorientierten Lieferung.

-

Entscheidungsbaum für Copilot vs. On-Prem. Wann ist Copilot erlaubt? Wann nicht? Wenn Daten reguliert oder besonders sensibel sind, standardmäßig On-Premises- oder Offline-Workflows verwenden. Wenn die Kundenbeziehung Copilot-Nutzung mit Richtlinienbeschränkungen zulässt, diese unter strengen Gates (Datenredaktion, von Richtlinien geprüfte Eingaben, Nachgenerations-Review) freigeben. Ein klares Flussdiagramm hilft Teams, in Echtzeit zu entscheiden.

-

Praktische Beispiele. Ein Vertriebsingenieur verwendet ein templatisiertes KI-PowerPoint-Makro, um ein generisches Deck mit redaktierten Kundendaten zu füllen, dann genehmigt ein Compliance-Reviewer die Version mit einem einzigen Klick. Das endgültige Deck wird in einem eingeschränkten Ordner mit Versionsverlauf und Export-Audit gespeichert.

-

Schulung und Kultur. Führen Sie regelmäßige Schulungen zu Datenklassifizierung, Redaktions-Techniken, Makro-Signierung und Audit-Bereitschaft durch. Verwenden Sie simulierte Kundendecks, um Governance-Workflows zu üben, damit Teams mit Richtlinien-Toren vertraut werden, bevor sie echte Kundenarbeiten übernehmen.

-

Relevante Governance-Themen. Dieser Ablauf schneidet sich mit Data-Loss-Prevention, Datenklassifizierung, NDA-Compliance, Makro-Sicherheit und Governance der Software-Lieferkette. Die Abstimmung dieser Bereiche reduziert das Risiko, wenn Sie KI-PowerPoint-Makro-Nutzung teamübergreifend skalieren.

Wesentliche Erkenntnis: Ein disziplinierter KI-PowerPoint-Makro-Workflow hängt von Daten-Governance, Modellauswahl, Signierung, Ausführung mit Minimalrechten, Redaktionsprozessen und auditierbaren Aufzeichnungen ab. Diese Elemente ermöglichen es Ihnen, Geschwindigkeit zu erhöhen, ohne NDAs oder Kundenverträge zu verletzen.

Warum das wichtig ist

Der Druck, Kundendokumente zu beschleunigen, ist greifbar. Im letzten Quartal sahen sich Unternehmenseinheiten einem wachsenden Spannungsverhältnis zwischen Geschwindigkeit und Sicherheit gegenüber, da KI-gestützte Tools in den Arbeitsablauf Einzug hielten. Anekdotische Belege aus Branchenbesprechungen zeigen zwei klare Muster:

-

Richtlinien-Friction nimmt zu. Beratende diskutieren auf Reddit über Untersuchungen zur Nutzung von GenAI für Kundendaten und die anschließenden Verbote oder Einschränkungen beim Umgang mit vertraulichen Dossiers. Praktiker berichten von der Notwendigkeit von Entscheidungsbäumen, die klar trennen, wann Copilot oder Tools von Drittanbietern für Folien erlaubt sind versus On-Premises- oder manuelle Methoden.

-

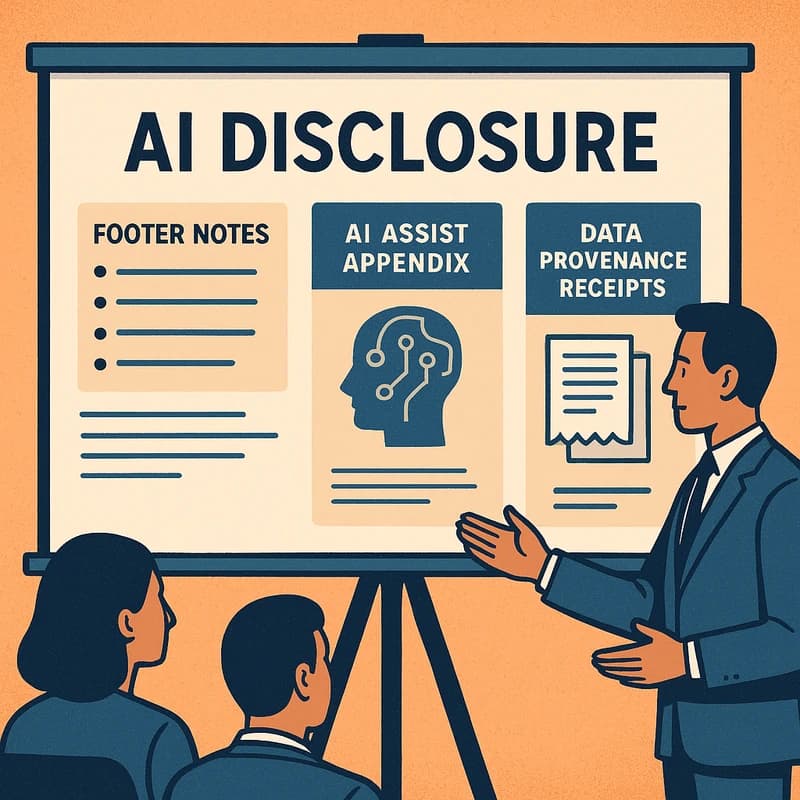

Nachfrage nach auditierbarer Governance wächst. LinkedIn und andere berufliche Netzwerke haben eine Welle von Eingabeaufforderungen hervorgehoben, die dazu auffordern: „Lass KI deine Folien erstellen“, was Bedenken über Datenlecks und Vertraulichkeit von Kundendaten auslöst. Unternehmen fordern zunehmend auditierbare Prompt-Protokolle und Makro-Ursprungsnachweise, um NDA- und regulatorische Erwartungen zu erfüllen.

Zwei bis drei Statistiken oder Branchentrends, mit denen Sie Ihre Planung verankern können:

- Unternehmen übernehmen zunehmends formale KI-Governance für Kundenarbeiten; die Akzeptanz von Governance steigt jährlich von den oberen Teenager-Prozenten zu den unteren Zwanzig-Prozenten. Dieser Wandel wird von Datenschutzbestimmungen und Kundenvertragsbeschränkungen angetrieben.

- Sicherheitsteams berichten von wachsender Sorge um Datenlecks, wenn KI zur Generierung von Kundendaten verwendet wird, was strengere Makro-Kontrollen, Inhaltsredaktion und sitzungsbasierte Zugriffspolitiken nach sich zieht.

- In Umgebungen, in denen KI zugelassen ist, setzen Teams auf Offline-/lokale Modelle oder unternehmensgerechte Copilots mit strengen Datenverarbeitungsrichtlinien, um Cloud-Leckagen zu vermeiden, oft in Verbindung mit robusten Audit-Trails und Genehmigungs-workflows.

Expertenperspektiven, die berücksichtigt werden sollten: Führungskräfte betonen, dass Geschwindigkeit mit Richtlinienkontrollen gekoppelt sein muss; Sicherheitsverantwortliche weisen auf die Notwendigkeit einer kennzeichnungsorientierten Redaktion und Makro-Signierung als Grundkontrollen für jeden klientenbezogenen KI-Arbeitsablauf hin.

Wesentliche Erkenntnis: Die aktuelle Situation verlangt einen hybriden Ansatz – nutzen Sie KI für Geschwindigkeit, aber verankern Sie jedes Deck in Governance, Redaktion und auditierbaren Prozessen, um Kundenerwartungen und regulatorische Anforderungen zu erfüllen.

Praktische Anwendungen

-

Vorausgefertigte Decks mit redaktionsbereiten Vorlagen. Erstellen Sie KI-unterstützte Folienvorlagen, die automatisch mit nicht-vertraulichen Platzhaltern aufgefüllt werden. Das Makro füllt Platzhalter zuerst in einer redigierten Version aus, die anschließend erst nach Freigaben überprüft und freigegeben wird.

-

Compliance-first Automatisierung. Verwenden Sie digitale Signaturen für jedes Makro und pflegen Sie ein zentrales Repository mit genehmigten Makros. Implementieren Sie automatische Checks, die Makro-Signaturen überprüfen und die Ausführung auf signierte, vertrauenswürdige Quellen beschränken.

-

On-Prem/Offline-KI für sensible Daten. Wenn Kundendaten sensibel sind, führen Sie den KI-Prozess vollständig offline aus. Speichern Sie Eingaben und Ausgaben in einer isolierten Umgebung und exportieren Sie erst nach Redaktions- und Freigaben.

-

Auditierbare Eingaben. Pflegen Sie eine Prompt-Bibliothek mit Versionskontrolle, die mit dem Deck verknüpft ist, das sie erstellt hat. Stellen Sie sicher, dass Prompts nur über eine kontrollierte Schnittstelle zugänglich sind und dass alle Prompt-Nutzungen protokolliert werden.

-

Entscheidungsbaum-gesteuerter Workflow. Fügen Sie im Onboarding einen einfachen Entscheidungsbaum ein: Wenn Daten vertraulich sind, On-Prem/Offline verwenden; wenn Daten geringes Risiko haben, Enterprise-Copilot mit Gates zulassen; always Redaction, Signing und Audit-Logging sicherstellen.

-

Praktisches Beispiel: Ein Produktmarketing-Team verwendet ein Makro, um ein Deck mit Platzhaltern für Kundendaten zu entwerfen. Redaction wird automatisch angewendet, das Makro wird signiert, und ein Compliance-Reviewer validiert das Deck, bevor es mit dem Kunden geteilt wird. Die endgültige Version befindet sich in einem eingeschränkten Ordner mit vollständigem Audit-Trail.

Wesentliche Erkenntnis: Operationalisieren Sie die Nutzung von KI-PowerPoint-Makros mit Vorlagen, Governance-Toren und auditierbaren Eingaben, um eine skalierbare, sichere Automatisierungs-Pipeline zu schaffen.

Experteneinsichten

-

Governance-first-Mentalität. Branchenexperten argumentieren, dass Governance der Automatisierung vorausgehen muss. In der Praxis bedeutet das, Datenklassifikationen, signierte Makros und auditierbare Logs festzulegen, bevor KI-gestützte Foliengenerierung für klientenbezogene Decks aktiviert wird.

-

Redaktion als Designprinzip. Redaktion ist kein zweiter Schritt; sie ist eine Designbeschränkung, die in das Makro integriert wird. Prompts sollten so gestaltet sein, dass sensibler Inhalt nicht eingebettet wird, und automatische Redaktion im Generierungsprozess angewendet wird.

-

Auditierbarkeit als Eigenschaft, nicht als Nebeneffekt. Die robustesten Workflows behandeln jede KI-Interaktion als auditierbares Ereignis. Dazu gehören Prompts, Modellentscheidungen, Makro-IDs und Genehmigungen.

-

Zukunftssicherheit durch Richtlinien. Mit der Entwicklung unternehmensweiter KI-Richtlinien sollten Teams Workflows entwerfen, die sich schnell anpassen lassen – vom Copilot-fähigen Pfad zu On-Prem-Pfaden wechseln, ohne wesentliche Prozessänderungen.

Wesentliche Erkenntnis: Experten empfehlen einen governance-first, redaktion-zentrierten, auditierbaren Ansatz, der mit der Richtlinienentwicklung und den Bedürfnissen des Unternehmens skaliert.

Häufig gestellte Fragen

- Ist es sicher, KI für Kundenvorträge zu verwenden?

- Wie kann ich vertrauliche Daten sicher halten, wenn ich KI mit PowerPoint verwende?

- Was ist Copilot in der PowerPoint-Compliance?

- Wie signiere und vertraue ich PowerPoint-Makros?

- Welche Risiken bestehen, dass KI-generierte Folien Daten preisgeben?

- Wann sollte ich KI in Kundendossiers aufgrund von Richtlinien vermeiden?

- Welcher Workflow gewährleistet Auditierbarkeit bei der Erstellung von KI-Decks?

- Wie kann Redaktion in KI-PowerPoint-Makros implementiert werden?

- Was ist mit Offline-/lokalen KI-Modellen für PowerPoint?

- Wie funktionieren Klassifikations-Gates in der Praxis?

- Wie implementiert man Minimalrechte (Least-Privilege) für Makros?

Wesentliche Erkenntnis: Ein strukturierter FAQ hilft Teams, schnell zu den genauen Richtlinien- und technischen Schritten zu navigieren.

Nächste Schritte

- Ordnen Sie Ihre Datentypen Ihrer KI-Richtlinie zu. Erstellen Sie eine Datenklassifikationsmatrix und stimmen Sie sie mit Ihrem Governance-Rahmenwerk für KI ab.

- Erstellen Sie eine redaktionsorientierte Makro-Vorlagenbibliothek. Entwickeln Sie Vorlagen, die Redaktionsregeln, Platzhalter und Audit-Logging durchsetzen.

- Etablieren Sie einen Signier- und Verteilungsprozess. Implementieren Sie digitale Signaturen für Makros und ein kontrolliertes Repository mit Zugriffskontrollen und Versionsverlauf.

- Erstellen Sie einen benutzerfreundlichen Entscheidungsbaum für Teams. Dokumentieren Sie, wann Copilot erlaubt ist und wann On-Prem/Offline-Methoden erforderlich sind, einschließlich Beispiel-Eingabeaufforderungen und Gate-Regeln.

- Führen Sie einen Pilotversuch mit bereichsübergreifenden Stakeholdern durch. Beziehen Sie Rechtsabteilung, Sicherheit, Produkt und kundenseitige Teams ein, um den End-to-End-Workflow zu testen, Risiken zu messen und Kontrollen zu verfeinern.

Wesentliche Erkenntnis: Governance in ein wiederholbares Playbook verwandeln – dann skalieren, iterieren und schulen.

Verwandte Themen für interne Verlinkung (hier ohne Links): KI-Governance, Data-Loss-Prevention, Datenklassifizierung, NDA-Compliance, Makro-Sicherheit, Governance der Software-Lieferkette, Prompt-Design, Auditierbarkeit, Versionskontrolle, Least-Privilege-Zugriff, Redaktions-Techniken, Offline-KI-Workflows, Enterprise-Copilot-Richtlinien, Umgang mit vertraulichen Daten, Compliance-Review-Prozesse.

Häufig gestellte Fragen (Fortsetzung)

- Ist es sicher, KI für Kundenvorträge zu verwenden?

- Wie kann ich vertrauliche Daten sicher halten, wenn ich KI mit PowerPoint verwende?

- Was ist Copilot in der PowerPoint-Compliance?

- Wie signiere und vertraue ich PowerPoint-Makros?

- Welche Risiken bestehen, dass KI-generierte Folien Daten preisgeben?

- Wann sollte ich KI in Kundendossiers aufgrund von Richtlinien vermeiden?

- Welcher Workflow gewährleistet Auditierbarkeit bei der Erstellung von KI-Decks?

- Wie kann Redaktion in KI-PowerPoint-Makros implementiert werden?

- Was ist mit Offline-/lokalen KI-Modellen für PowerPoint?

- Wie funktionieren Klassifikations-Gates in der Praxis?

- Wie implementiert man Minimalrechte für Makros?

Schlussbemerkung von Mei Lin: Am Schnittpunkt von KI-Geschwindigkeit und Kundenvertrauen sollte Ihr Deckbauprozess wie eine kuratierte Ausstellung wirken — jedes Artefakt (Daten, Eingabeaufforderung, Makro) wird durch einen sorgfältigen Rahmen geschützt (Richtlinien, Redaktion, Signierung). Wenn Teams einen transparenten, auditierbaren Workflow übernehmen, verwandeln sie die Angst vor KI in Vertrauen in Ergebnisse. So erstellen Sie kundennabene Decks im Tempo der Ideen, ohne Sicherheit oder Verträge zu gefährden.