Opdag hvordan AI PowerPoint-makro-workflows balancerer hastighed og sikkerhed med radering, signering og auditerbare forespørgsler for at levere overensstemmende klientpræsentationer.

Hurtigt svar

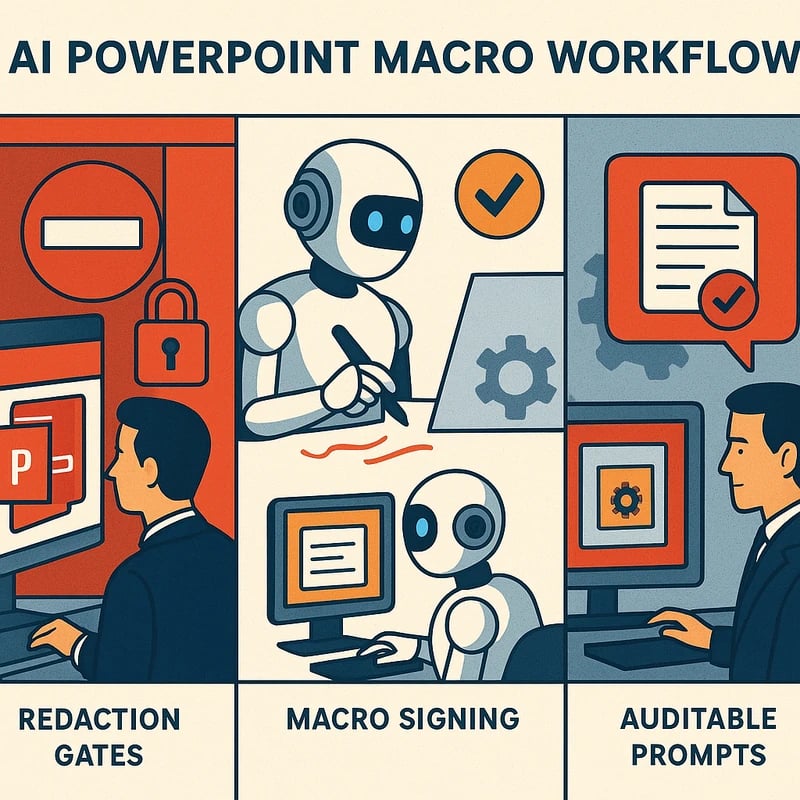

AI PowerPoint-makroets hastighed kan ændre produktionen af klientpræsentationer, men sikkerhed og politikdisciplin er ikke til forhandling. Den definitive arbejdsgang kombinerer redaktion før generation, offline eller virksomheds-godkendte modeller, makro-signering, udførelse med mindst privilegeret adgang og auditable prompts. Når politiske adgangsgates er på plads, brug Copilot-aktiverede workflows med styring eller skift til on-premise/manuel metoder for at beskytte NDA’er og fortrolige data.

Nøglepointer: hastighed uden foranstaltninger er ikke skalerbar—du har brug for en auditerbar, politik-drevet proces for brug af AI PowerPoint-makroer.

Den komplette guide til AI PowerPoint-makro

Kontekst har betydning, når du bygger kundevendte slides. Balancen mellem hastighed og sikkerhed er ikke et kompromis, du kan acceptere som en given; det er et styringsproblem med praktiske, gentagelige trin. Denne guide skitserer en virksomheds-klar arbejdsgang for brug af AI PowerPoint-makroer, der respekterer dataafgrænsninger, klientkontrakter og interne kontroller.

-

Data-klassifikation først. Definér, hvad der må bruges i AI-assisteret generation, og hvad der skal redigeres bort eller omdannes til placeholders. Gennemfør en vurdering af datafølsomhed, inden du rører klientindhold med AI-værktøjer. Brug mærkningsporte (Public, Internal, Confidential, Restricted), som matcher dine DLP- og datatabforebyggelsessystemer. En robust AI PowerPoint-makro-arbejdsgang behandler indhold som data, der kræver beskyttelse som standard.

-

Lokale eller virksomhedsgodkendte modeller. Foretræk offline eller on-prem AI-muligheder for alt, der berører fortroligt indhold. Hvis du er nødt til at bruge cloud-modeller, dirigér kun ikke-fortrolige prompts eller anvend en gennemset enterprise-model med strenge aftaler om datahåndtering og sessionsbaseret isolation. Enterprise-modellen bør overholde opbevaringsgrænser og må ikke eksportere data uden for din kontrol. Dette sikrer, at AI PowerPoint-makro-output forbliver inden for din virksomheds grænser.

-

Makro-signering og tillid. Sikr, at hver AI-genereret makro eller makro-assisteret skabelon er digitalt signeret af en betroet udgiver. Etabler en politik, der forbyder utruvede makroer at køre uden en formel godkendelsesworkflow. Brug kode-signeringcertifikater og et centraliseret makro-lager med versionskontrol og tilbagekaldelsesprocedurer.

-

Mindst privilegeret udførelse. Kør PowerPoint-makroer med de nødvendige mindst privilegerede rettigheder og uden administratorrettigheder på slutbrugerens enheder. Begræns netværksadgang for makro-aktiverede sessioner og deaktiver eller sandkassér netværkskald, der kan lække indhold. Anvend applikationshvidliste, så kun godkendte makroer udføres i kontrollerede miljøer.

-

Politikvenlige prompts. Udform prompts, der undgår at anmode om eller udlede fortrolige detaljer. Brug placeholders (f.eks. [CLIENT_NAME], [CONTRACT_VALUE]), som kun udskiftes i et sikkert, redigeret miljø. Vedligehold et promptbibliotek, der stemmer overens med din datastyringspolitik, NDA-vilkår og klient-specifikke restriktioner.

-

Redaktionsporte og klassifikationsintegration. Før et deck forlader dit miljø, kør en automatiseret redaktion for at fjerne eller maskere følsomme identifikatorer. Knyt redaktionsprocessen til dit data-klassifikationsskema, så hver prompts outputs forbliver inden for politik-kompatible grænser.

-

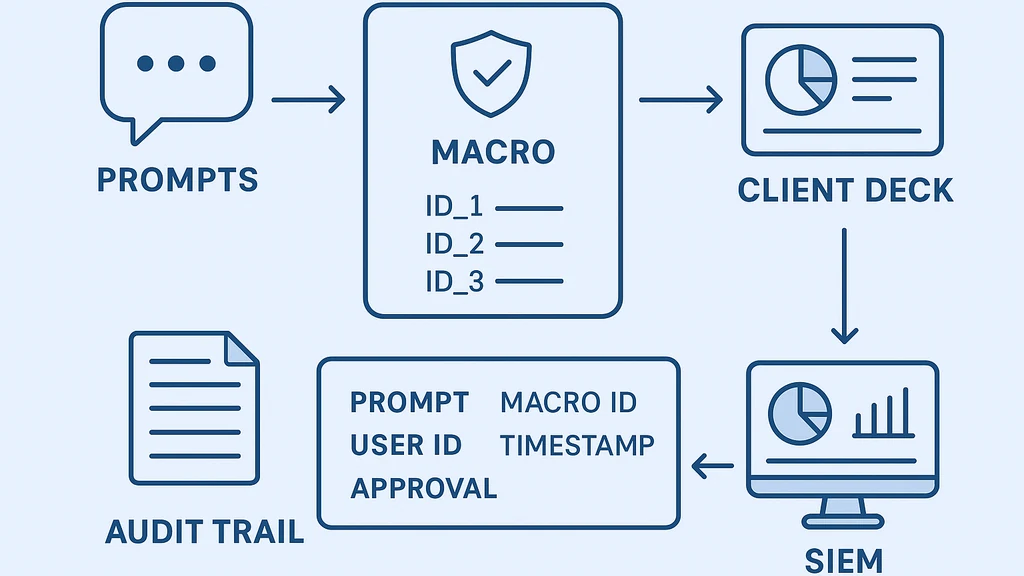

Auditable prompts og outputs. Log prompts, inputs, outputs, makro-ID’er, bruger-ID’er, tidsstempler og godkendelser i et uforanderligt revisionsspor. Knyt dette spor til et virksomhedsanalyset eller sikkerhedsoplysnings- og hændelseshåndteringssystem (SIEM). Gør det nemt for reviewers at spore, hvordan et deck blev produceret, hvilke data der blev brugt, og hvem der godkendte det.

-

Versionsstyring og godkendelser. Brug et formelt deck-versioneringssystem, hvor godkendelser kræves for hvert AI-assisteret deck, der er tiltænkt klientlevering. Følg ændringerne, gem begrundelsen for AI-valgene, og krav en godkendelse fra en data governance- eller sikkerhedschef, før levering til klient.

-

Beslutningstræ til Copilot vs on-prem. Hvornår er Copilot tilladt? Hvornår er det ikke? Hvis data er regulerede eller særligt følsomme, brug som standard on-prem eller offline arbejdsgange. Hvis klientforbindelsen tillader Copilot-brug med politikbegrænsninger, aktiver det under strenge porte (dataredaktion, prompts gennemgået af politik, og efter-generation gennemgang). En tydelig flowchart hjælper teams med at beslutte i realtid.

-

Praktiske eksempler. En tekniker fra salg bruger en skabelonbaseret AI PowerPoint-makro til at udfylde et generisk deck med redigerede kundemålinger, hvorefter en compliance-godkender godkender versionen med et enkelt klik tilslutning. Det endelige deck gemmes i en begrænset mappe med versionshistorik og en eksport-revisionssporlog.

-

Uddannelse og kultur. Gennemfør regelmæssig træning i data-klassificering, redaktionsteknikker, makro-signering og revisionsberedskab. Brug simulerede klient-decks til at øve governance-workflows, så teams er fortrolige med politikporte, før de går i gang med virkelig klientarbejde.

-

Relaterede governance-emner. Dette arbejdsgang møder data-tab-forebyggelse, data-klassificering, NDA-overholdelse, makro-sikkerhed og software-forsyningskæde-styring. Tilpasning af disse domæner reducerer risiko, når du skalerer brugen af AI PowerPoint-makroer på tværs af teams.

Nøglepointer: En disciplineret AI PowerPoint-makro-arbejdsgang hviler på data governance, modelvalg, signering, mindst privilegeret adgang, redaktion og auditable registreringer. Disse elementer giver dig mulighed for at øge hastigheden uden at overtræde NDA’er eller klientkontrakter.

Hvorfor dette er vigtigt

Trykket for at fremskynde klientpræsentationer er håndgribeligt. I sidste kvartal stod virksomhedsteams over for en voksende spænding mellem hastighed og sikkerhed, efterhånden som AI-aktiverede værktøjer kom ind i arbejdsgangen. Anecdotiske oplysninger fra branchedebatter viser to klare mønstre:

-

Politikfriktion stiger. Reddit-diskussioner blandt konsulenter understreger undersøgelser af at bruge GenAI til klientindhold og de efterfølgende forbud eller restriktioner, når man håndterer fortrolige decks. Praktikere rapporterer behov for beslutningstræer, der klart adskiller, hvornår Copilot eller tredjeparts diasværktøjer er tilladt versus on-prem eller manuelle metoder.

-

Efterspørgslen efter auditable governance vokser. LinkedIn og andre professionelle netværk har fremhævet en bølge af prompts, der opfordrer til “lad AI lave dine slides,” hvilket udløser bekymringer om data-lækage og klientfortrolighed. Virksomheder kræver i stigende grad auditable prompt-logfiler og makro-afstamning for at imødekomme NDA’er og regulatoriske forventninger.

To til tre statistikker eller branchetrends, du kan forankre din planlægning i:

- Virksomheder tager i stigende grad formel AI-styring i brug for klientarbejde, med styringsadoption, der stiger i højeste tiere til laveste tiere procenter år for år. Dette skift drives af databeskyttelsesregler og kontraktlige klientkrav.

- Sikkerhedsteams rapporterer en voksende bekymring for data-lækage, når AI bruges til at generere klientindhold, hvilket fører til strengere makro-kontroller, indholdredaktion og session-baserede adgangspolitikker.

- I miljøer, hvor AI er tilladt, læner teams sig mod offline/lokale modeller eller virksomhedskvalitets Copilots med strenge datahåndteringspolitikker for at undgå cloud-lækage, ofte i kombination med robuste revisionsspor og sign-off-workflows.

Eksperter understreger, at hastighed skal kombineres med politikkontroller; sikkerhedsledere peger på nødvendigheden af klassifikationsdreven redaktion og makro-signering som grundlæggende kontroller for enhver klient-til AI-arbejdsproces.

Nøglepointer: Det nuværende øjeblik kræver en hybrid tilgang — brug AI for hastighed, men forankr hvert deck i styring, redaktion og auditable processer for at imødekomme klientforventninger og regulatoriske krav.

Praktiske anvendelser

-

Forbered decks på forhånd med redaktionsklare skabeloner. Skab AI-assisterede dias-skabeloner, der automatisk udfylder ikke-fortrolige pladsholdere. Makroen udfylder pladsholderne i en redigeret version først, som derefter gennemgås og frigives kun efter godkendelser.

-

Overholdelses-først automation. Brug digitale signaturer på hver makro og oprethold et centraliseret lager af godkendte makroer. Implementér automatiske kontroller, der verificerer makro-signaturer og begrænser kørsel til signerede, betroede kilder.

-

On-prem/offline AI til følsomme data. Når klientdata er følsomme, kør AI-processen helt offline. Opbevar prompts og output i et isoleret miljø og eksporter kun efter redaktion og godkendelser.

-

Audit-klare prompts. Vedligehold et promptbibliotek med versionerede prompts, der er knyttet til det deck, de producerede. Sikr, at prompts kun er tilgængelige gennem en kontrolleret grænseflade, og at al prompt-brug logges.

-

Beslutningstræ-drevet arbejdsgang. Inkludér et simpelt beslutningstræ i onboarding-materialerne: Hvis data er fortroligt, brug on-prem/offline; hvis data er lavrisiko, tillad enterprise Copilot med porte; kræv altid redaktion, signering og revisionslog.

-

Realistisk eksempel: Et produktmarkedsføringshold bruger en AI PowerPoint-makro til at udarbejde et deck med placeholders for kundedata. Redaction anvendes automatisk, makro signeres, og en compliance-godkender validerer decket, før det deles med klienten. Den endelige version gemmes i en begrænset mappe med fuld revisionsspor.

Nøglepointer: Operationalisér brugen af AI PowerPoint-makroer med skabeloner, governance-gates og auditable prompts for at skabe en skalerbar, sikker automatiseringspipeline.

Ekspertindsigter

-

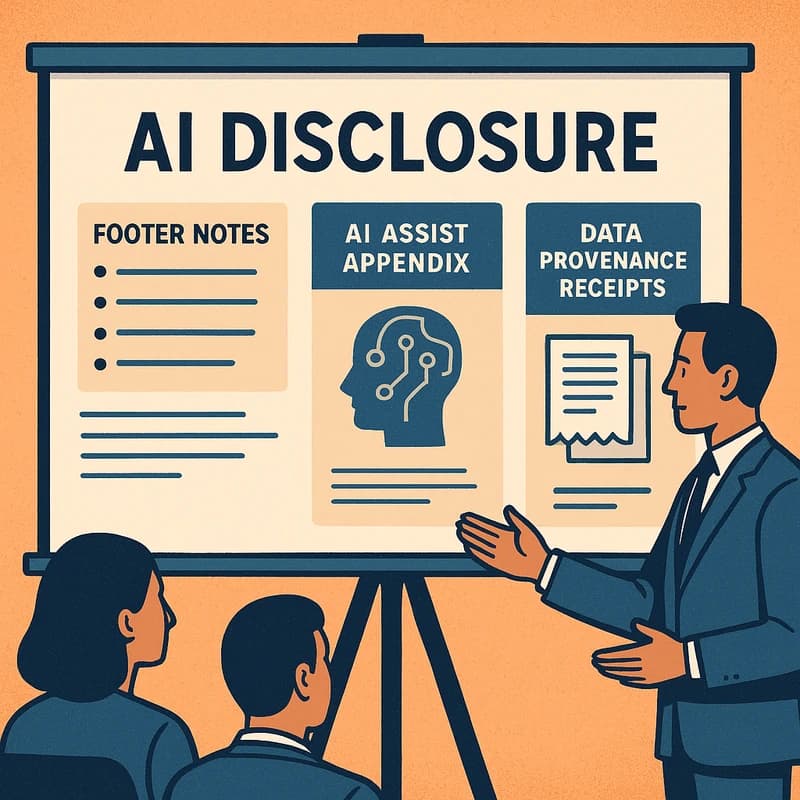

Governance-først tænkning. Brancheeksperter hævder, at governance skal forudgå automation. I praksis betyder det at etablere data-klassifikationer, signerede makroer og auditable logs, før AI-assisteret dias-generering for klientpræsentationer sættes i gang.

-

Redaktion som designprincip. Redaktion er ikke et sekundært trin; det er en designbegrænsning indlejret i makroen. Prompts bør designes til at undgå at indlejre følsomt indhold, med automatisk redaktion anvendt i generationsprocessen.

-

Auditabilitet som funktion, ikke som biprodukt. De mest robuste arbejdsgange behandler hver AI-interaktion som en auditerbar begivenhed. Dette omfatter prompts, modelvalg, makro-ID’er og godkendelser.

-

Fremtidssikring gennem politik. Efterhånden som virksomheders AI-politikker udvikler sig, bør teams designe arbejdsgange, der hurtigt kan tilpasses — skift fra Copilot-aktiverede veje til on-prem-veje uden betydelige procesændringer.

Nøglepointer: Eksperter anbefaler en governance-først, redaktionelt centreret, auditable tilgang, der kan skalere i takt med policy-udvikling og virksomhedens behov.

Almindelige spørgsmål

- Er det sikkert at bruge AI til klientpræsentationer?

- Hvordan kan jeg holde fortrolige data sikre, når jeg bruger AI med PowerPoint?

- Hvad er Copilot i PowerPoint-overholdelse?

- Hvordan signer og tillader jeg PowerPoint-makroer?

- Hvad er risiciene ved AI-genererede slides, der lækker data?

- Hvornår bør jeg undgå AI i klientdeck på grund af politik?

- Hvilken arbejdsgang kan sikre auditabilitet for AI deck-oprettelse?

- Hvordan kan redaktion implementeres i AI PowerPoint-makro?

- Hvad med offline/lokale AI-modeller til PowerPoint?

- Hvordan fungerer klassifikationsporte i praksis?

- Hvordan implementeres mindst privilegeret adgang for makroer?

Nøglepointer: En struktureret FAQ hjælper teams med hurtigt at navigere til den nøjagtige politik og de tekniske trin, de har brug for.

Næste skridt

- Kortlæg dine data-typer til din AI-politik. Opret en data-klassifikationsmatrix og tilpas den til dit AI-styringsrammeværk.

- Byg en redaktions-drevet makro-skabelonbibliotek. Udvikl skabeloner, der håndhæver redaktionregler, placeholders og revisionslog.

- Etablér en signerings- og distributionsproces. Implementér digitale signaturer for makroer og et kontrolleret repository med adgangskontroller og versionshistorik.

- Skab en nem at bruge beslutningstræ for teams. Dokumentér hvornår Copilot er tilladt og hvornår on-prem/offline metoder er påkrævet, inklusive eksempel-prompts og adgangsbegrænsninger.

- Kør et pilotforløb med tværfaglige interessenter. Involver juridisk, sikkerhed, produkt og klientrettede teams for at afprøve end-to-end arbejdsgang, måle risiko og forfine kontroller.

Nøglepointer: Gør styring til en repeterbar operationsmanual – derefter skalere, iterere og uddanne.

Relaterede emner til intern linking (ingen links er angivet her): AI-styring, datatab-forebyggelse, data-klassificering, NDA-overholdelse, makro-sikkerhed, software-forsyningskæde-styring, promptdesign, auditabilitet, versionskontrol, mindst priviligieret adgang, redaktionsteknikker, offline AI-arbejdsgange, enterprise Copilot-politikker, fortrolige datahåndtering, compliance- gennemgangsprocesser.

People Also Ask

Er det sikkert at bruge AI til klientpræsentationer?

Ja, men kun i en governance-drevet workflow. Brug redaktion, offline/on-prem modeller til følsomme data, og auditerede prompts med makro-signering. Den sikre tilgang lægger vægt på et kontrolleret miljø, data-klassifikationsporte og et auditerbart spor fra prompt til deck-levering. Nøglepointer: Sikkerhed kommer fra styring, ikke kun værktøj.

Hvordan kan jeg holde fortrolige data sikre, når jeg bruger AI med PowerPoint?

Klassificér data, rediger følsomme elementer, og sikre at makro- og prompt-begrænsninger forhindrer lækage. Kør AI-processer i isolerede miljøer, gem output inden for begrænset lagring, og kræv godkendelse før deling af klientrettede decks. Nøglepointer: Redaction og isolation er grundlæggende.

Hvad er Copilot i PowerPoint-overholdelse?

Copilot i PowerPoint-overholdelse refererer til brug af Copilot-aktiverede arbejdsgange, hvor politikporte håndhæves, data beskyttes, og prompts auditeres. Det er tilladt kun, når virksomhedspolitikkerne er opfyldt — ellers skift til on-prem/offline metoder. Nøglepointer: Copilot kan fremskynde sessioner, men kun med guardrails.

Hvordan signer og tillader jeg PowerPoint-makroer?

Brug digitale signaturer fra en betroet certifikatmyndighed, vedligehold et centralt, versionsstyret makro-lager og håndhæv politik-baseret udførelse, der kun tillader signerede makroer at køre i kontrollerede miljøer. Nøglepointer: Signering opbygger tillid og reducerer risiko.

Hvad er risiciene ved AI-genererede slides, der lækker data?

Risici inkluderer utilsigtet eksponering af fortrolige data gennem prompts eller genereret indhold, lækage af træningsdata og ukonfineret data, der forlader virksomheden gennem cloud-baserede værktøjer. Afbødning afhænger af redaktion, on-prem/offline behandling og stramme adgangskontroller. Nøglepointer: Guardrails reducerer lækagerisiko.

Hvornår bør jeg undgå AI i klientdeck på grund af politik?

Hvis data er regulerede, NDA-tunge eller kan kompromittere fortrolige kundedata, skift til non-AI eller on-prem processer med alle relevante godkendelser. Politikfriktion styrer ofte disse beslutninger mere end teknisk formåen.

Nøglepointer: Ved tvivl – vælg sikkerhed og compliance.

Hvilken arbejdsgang kan sikre auditabilitet for AI deck-oprettelse?

Log hvert prompt, makro-ID og output; kræv godkendelser for hvert deck; opbevar et forvaret revisionsspor; og centraliser prompts, modeller og makro-signaturer i et styret repository. Nøglepointer: Auditabilitet er troværdighedens rygrad.

Hvordan kan redaktion implementeres i AI PowerPoint-makro?

Indlejre redaktionssteg i makroen: registrer følsomme felter, erstat dem med neutrale pladsholdere, og sørg for at redigeret indhold bekræftes af en reviewer, før det deles eksternt. Nøglepointer: Redaction bør være automatiseret og verificérbar.

Hvad med offline/lokale AI-modeller til PowerPoint?

Offline/lokale modeller reducerer eksponeringsrisiko. De kræver robust pakning, sikker modelopbevaring og streng styring af prompts og outputs — ideelt integreret i et auditerbart workflow. Nøglepointer: Lokale modeller er en mere sikker standard for følsomt klientindhold.

Hvordan fungerer klassifikationsporte i praksis?

Klassifikationsporte kortlægger data-typer til håndteringsregler inden for makroens pipeline. Hvis indhold er Fortroligt eller Begrænset, udgår makroen redigeret indhold og/eller blokerer deling indtil godkendelse. Nøglepointer: Porte håndhæver politikken før output.

Hvordan implementeres mindst privilegeret adgang for makroer?

Kør makroer med minimale tilladelser, begræns netværksadgang, håndhæv hvidliste, og adskil udvikling, test og produktion makro-miljøer for at minimere blast radius. Nøglepointer: Mindst privilegeret adgang mindsker angrebsoverfladen.

Afsluttende bemærkning fra Mei Lin: I krydsfeltet mellem AI-hastighed og klienttillid bør din deck-building-proces læse som en kurateret udstilling — hvert artefakt (data, prompt, makro) beskyttet af en omhyggelig ramme (politik, redaktion, signering). Når teams adopterer en gennemsigtig, auditerbar arbejdsproces, omdanner de frygt for AI til tillid til resultater. Det er sådan, du skaber klientklar decks i idéernes tempo uden at gå på kompromis med sikkerhed eller kontrakter.